- +1

AI修復老片又快又好,但還取代不了專業修復師

作者| Decode

郵箱|oudibj@outlook.com

AI 修復一百年前攝于北京的視頻,想必大家都看過了,但你知道 AI 具體是怎么做的嗎?

(還沒看過的可以點上面視頻)

據南方都市報報道,作者 @大谷 Spitzer 修復這個視頻的過程,主要有三部分,分別是補幀、上色和分辨率擴增。

翻譯成白話,這三部分對應的是:讓視頻變得更流暢,比如把 24 幀變成 60 幀;讓黑白視頻變彩色;讓視頻變得更清晰,比如把 480P 變成 4K 分辨率。

具體到工具,@大谷 Spitzer 補幀用的是 DAIN,上色用的是 DeOldify,分辨率擴增用的是 ESRGAN。

AI 是怎么修復老片的?

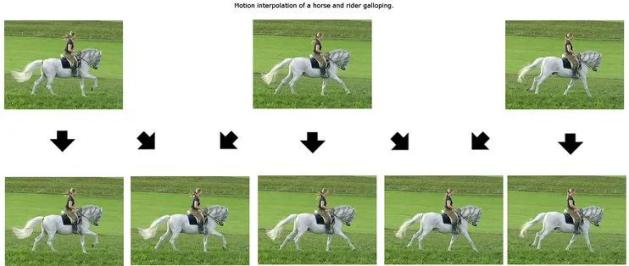

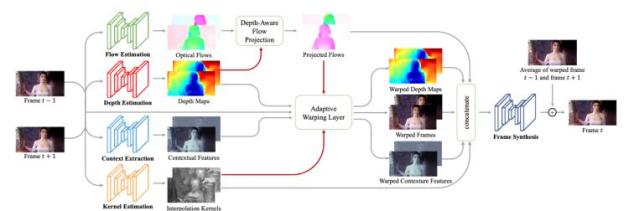

先來看補幀的 DAIN。這是一個基于視頻深度信息感知的時間幀插值算法,由上海交通大學,加利福尼亞大學和 Google 多方聯合研發。

為了方便更多用戶使用,研發者還提供了一個免費的 Windows 軟件“DAIN-App”。

在視頻領域,補幀其實不是件多新鮮的事。比如索尼電視的 Motionflow 技術和 AMD 顯卡的 Fluid Motion 都是常見的補幀方案。

這些補幀方法都有一定局限性,如果畫面里有大面積運動的物體,或者存在遮擋情況,補出來的影像就不是那么完美了。而 DAIN 所采用的方法,能很好解決這一問題。

DAIN 算法不會直接生成畫面,而是先通過獲取視頻深度信息,檢測出物體遮擋情況。然后,從相鄰像素收集上下文信息,來完成層次特征學習。最后,基于上述信息生成視頻幀。

簡言之,DAIN 在模擬生成一幀畫面之前,額外做了很多工作。它讓計算機知道了一個平面視頻里,不同物體之間的遠近關系和遮擋情況。并且,用了一種更有效率的方式,來對像素點進行采樣,以生成更高質量的畫面。

這樣做的結果是,DAIN 生成的補幀畫面,比起傳統補幀方法,更像真實拍攝的。

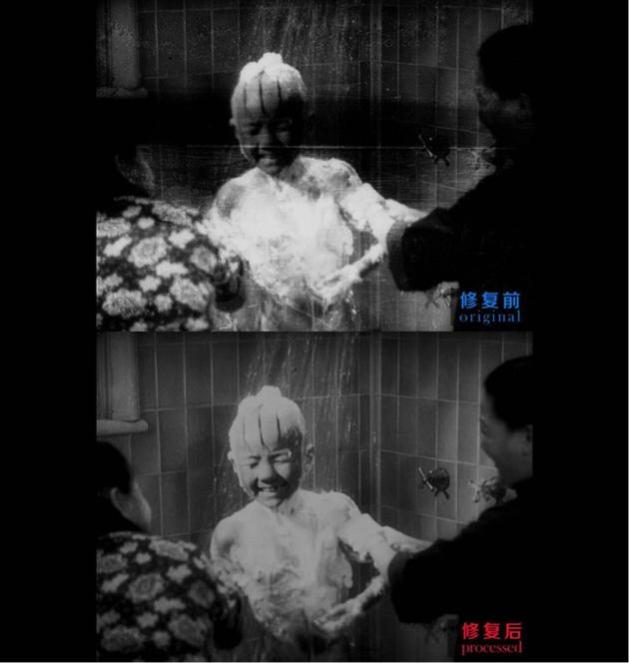

在 @大谷 Spitzer 修復的視頻里,如果仔細對比原片和 AI 修復片段,很容易可以感受到 DAIN 補幀的效果。比如下面這個場景里的人物動作,原片能感受到卡頓,而 AI 修復后流暢很多。

視頻上色方面,@大谷 Spitzer 用到了 DeOldify,這是一個在深度學習圈非常熱門的項目。

DeOldify 基于一種名為 GAN(生成對抗網絡)的技術。GAN 被 AI 界的領袖 Yann LeCun 稱為 “過去 10 年機器學習中最有趣的想法”,它通過兩個神經網絡相互博弈的方式來學習數據,能生成逼真的新內容,其中一個廣為人知的應用,是可以換臉的 Deepfake。

DeOldify 采用了一種改良過的 GAN 模型,即保留了 GAN 訓練的優點(絢爛的色彩),又消除了視頻中物體閃爍等副作用。

不過,DeOldify 所呈現的色彩還原結果,并不一定是真實的情況。

“歷史上這個人穿的是不是這個顏色,我覺得不然。”@大谷 Spitzer 接受中新視頻采訪時說,“它(AI)只是一個憑自己的訓練,感覺這個人可能是這個顏色,那個人穿衣服有可能是那個顏色,它沒法做到完全歷史精確。”

正因如此,@大谷 Spitzer 也在視頻里標注了:色彩為 AI 自我學習結果,不代表歷史原色。

把一張圖片放大超過其原本分辨率,是很多人經常會做的事。這樣的結果是,圖片會變得模糊,因此就有人去研究,怎么把圖片發大超過分辨率,而不變得模糊。

ESRGAN 利用深度學習方法來解決這一問題,相比傳統方法,能得到更好的效果。

用 AI 修復一段百年前北京的影片,固然非常有意義,但這項技術的應用,遠不止于在社交網絡刷刷屏。

不管是在線視頻網站還是大熒幕,老片修復都是正在興起的風潮,而 AI 在背后扮演著加速器的角色。

據《中國經濟周刊》報道,優酷平臺大數據發現,有很多用戶來視頻平臺是來看老片子的,像《還珠格格》這樣的劇,能夠一直保持在流量高位上。

愛奇藝也通過大數據分析發現,經典老片具有非常廣泛的用戶基礎,受眾規模很大。在數據支持下,優酷和愛奇藝都發起了各自的老片修復計劃。

而修復大熒幕電影,重新在影院上映,這事一直在進行著,遠到 2009 年王家衛導演的《東邪西毒》修復上映,近到 4K 修復版的《三毛流浪記》和《海上鋼琴師》。

事實上,自 2006 年起,中國就啟動了“電影檔案影片數字化修復工程”。中國電影資料館主要負責這項工作,計劃把中國 4 萬部老電影膠片做數字化修復、存檔。

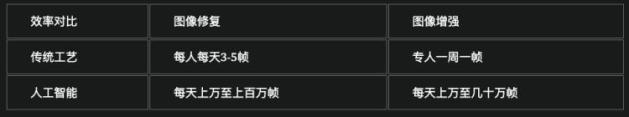

過去,老電影修復主要依靠人工,耗時耗力。據新京報報道,一天一個修復師一般只能完成 100 到 200 幀的畫面修復,一部保存完好的電影,簡單修復就需要兩個星期。

若是要達到美學標準,一幀幀地精心還原,需要幾個月甚至一兩年時間,若是遇到損傷非常嚴重的老電影,例如創作于 1930 年代的《漁光曲》,要近兩年時間才能完成。

越來越多團隊開始借助 AI 這塊它山之石。愛奇藝自主研發了 ZoomAI 視頻增強技術,優酷也用阿里云的“畫質重生”技術來修復老片。

在接受中國經濟周刊采訪時,愛奇藝副總裁謝丹銘說:“一部兩個小時的影片,(ZoomAI)只需要 12 小時即可完成修復增強并上線,這在之前是 10 人團隊近 20 天時間才能完成的工作量。與人工相比,ZoomAI 視頻處理效率可提高 500 倍。”上文提到的《三毛流浪記》,正是由愛奇藝投資和參與修復的。

中影數字制作基地和中國科技大學,也共同研發了一個基于 AI 的圖像處理系統“中影·神思”。

這個系統采用了 GAN、DenseNet、CycleGAN 網絡等技術,由三部分組成,分別是分辨率提升畫質增強處理單元、標清圖像去場處理單元和圖像數字修復處理單元。

借助“中影·神思”系統,中影基地已經成功修復了《厲害了,我的國》、《馬路天使》、《血色浪漫》和《亮劍》等多部影視劇。

以《厲害了,我的國》這部電影為例,由六集紀錄片《輝煌中國》改編而成,幾乎沒有新的實拍素材。原片按電視的 720X576 分辯率拍攝,修復時要擴大到 2K 分辨率。片子一拉大,“場紋、馬賽克、鋸齒等問題就全出來了”。

若采用純人工方式去修復,每人每天平均只能制作 3–5 幀鏡頭。但借助“中影·神思”系統,修復團隊得以在四個月內修復增強了 30 萬幀圖像。

更關鍵的是,很多以前無法修復的電影現在可以修了。肖搏舉了一個例子:1949 年王濱導演的《橋》,畫面重影很嚴重,膠片掃出來以后每個人物每一幀都有一個虛邊。非常難處理,“當時我們放棄了,但現在用人工智能技術就可以解決”。

老片修復不僅是技術,更是藝術

AI 加速了老片修復的速度,但也有一定局限性。比如上文提到的,@大谷 Spitzer 用 AI 修復一百年前的老片時,對色彩還原并不準確。

“如果是由人類藝術家來做的話,他肯定是了解中國古代歷史,做得應該就會更準確。”@大谷 Spitzer 說。

在專業的電影老片修復過程中,對色彩把握更是一門藝術。肖搏接受媒體采訪時說,他曾修復新中國第一部彩色片《梁祝》,“桑弧導演去世了,當時的攝影師也故去了。色調的濃稠就很難界定,我們調色調了 7、8 版,需要多方專家一起來定奪”。

對老片的修復,有時候還講究“修舊如舊”,而不是單純地把色彩修得好看。諸如此方面的把握,AI 還很難做到令人滿意。

據光明日報報道,中國電影資料館對于老電影修復,有兩組人員,一組是藝術專家組,另一組是技術專家組,兩組人員缺一不可。

毫無疑問,AI 加速了老電影修復,但暫時還取代不了專業的電影修復師。畢竟,影視片是一種藝術表達手段。

閱讀原文

原標題:《AI修復老片又快又好,但還取代不了專業修復師》

本文為澎湃號作者或機構在澎湃新聞上傳并發布,僅代表該作者或機構觀點,不代表澎湃新聞的觀點或立場,澎湃新聞僅提供信息發布平臺。申請澎湃號請用電腦訪問http://renzheng.thepaper.cn。

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2024 上海東方報業有限公司