- +1

計算的限度 —— 魏岑鮑姆與聊天機器人ELIZA

約瑟夫·魏岑鮑姆于20世紀60年代開發的ELIZA,堪稱有史以來最具影響力的計算機程序之一。ELIZA,尤其是其最著名的人格DOCTOR,至今仍是程序員的靈感源泉。它引發了關于人工智能(AI)更廣泛的討論,催生了諸多對其的模仿。作為所有對話界面和聊天機器人的鼻祖,ELIZA尤其令研究AI和計算領域的工程師、歷史學家和哲學家著迷。ELIZA能憑借相對少量的計算機代碼生成類人回應,這一能力為大量類似程序鋪平了道路。這些程序以對話智能體和其他人機界面的形式出現,在計算機科學領域催生出數個全新的研究領域。本文將探討魏岑鮑姆對AI的貢獻,并結合生成式AI(如ChatGPT)的當代發展狀況,思考其更具批判性的著作。此外,本文還將通過研究有關ELIZA的討論,為當前圍繞機器學習和AI的爭論提供一些思路。本文原題為“The Limits of Computation: Joseph Weizenbaum and the ELIZA Chatbot”,原刊于Weizenbaum Journal of the Digital Society 3(3),由譯者以CC-BY協議許可翻譯并發表在《智能社會研究》2024年第6期。大衛·貝里(D.Berry)任職于薩塞克斯大學媒體、藝術與人文學院。王立秋為哈爾濱工程大學人文社會科學學院講師。澎湃新聞經授權刊發。

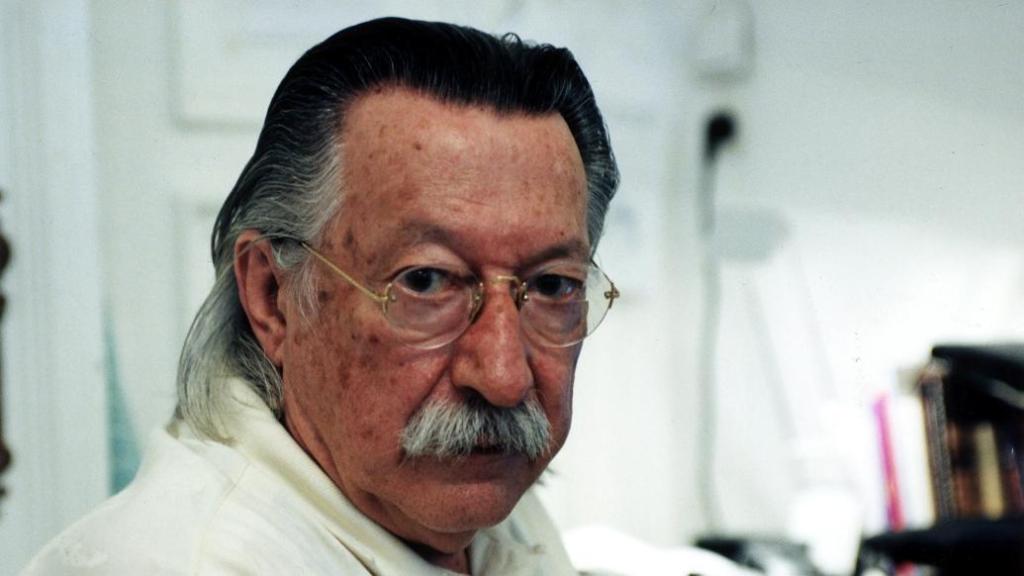

約瑟夫·魏岑鮑姆

一、引言

人工智能(AI)承諾采集并重塑人類最強大的能力—語言、創造力、推理和智力的本質。進步正飛速發生,在過去短短十年間,AI就產生了實際影響,自2019年以來,這種發展更是顯著加速。2022年,像OpenAI的ChatGPT和StabilityAI的StableDiffusion這樣的突破,被認為以前所未有的方式提升了人類在語言和藝術方面的創造力與生產力。在本文中,我想聯系ELIZA來思考這一領域近來的進展。在許多人看來,ELIZA是如今所謂生成式AI的前身,它是一個相對簡單的聊天機器人(對話智能體)程序,使計算機內基于對話的界面成為可能。

ELIZA由約瑟夫·魏岑鮑姆于20世紀60年代開發。可以說,它是有史以來最具影響力的計算機程序之一。ELIZA,尤其是其最著名的人格DOCTOR,仍然吸引著程序員,并催生了各種對它的模仿。雖然ELIZA影響了計算機科學乃至更廣泛的文化,但它的初始源代碼從未被公布或廣泛傳播。[1]不過,它是所有聊天機器人的前身、對話式人機互動的鼻祖,也是大眾對計算機可能形象的想象(如1968年電影《2001:太空漫游》中的HAL9000和2013年電影《她》中的操作系統)的靈感來源。這個所有對話界面和聊天機器人的始祖仍然令研究人工智能和計算的工程師、歷史學家和哲學家尤為著迷。值得注意的是,ELIZA在對計算歷史產生實質性影響的同時,也使其永遠陷入與性別和階級的問題性假設的糾葛之中(見下文)。ELIZA能夠利用相對少量的計算機代碼生成類人回應,憑借這一能力為大量類似程序鋪平了道路。這些程序以對話智能體和其他人機界面的形式出現,在計算機科學內部激發了幾個全新的研究領域(Boden,1977)。

值得注意的是,OpenAI在2022年發布ChatGPT,為復雜大語言模型(LLM)系統GPT3設計合適界面時,決定采用聊天機器人的形式。雖然該公司尚未充分解釋使用這種基于文本的模型背后的邏輯,但使用該系統本身就表明,很可能是創造人格的能力促使開發者這樣設計系統。為進一步探究這一點,本文認為,回顧過去對理解像ChatGPT和類似產品這樣的AI產品的特殊性或許有用。這就意味著要思考以前的系統,尤其是ELIZA。我尤其想要考察約瑟夫·魏岑鮑姆(Weizenbaum,1976)在《計算機的力量和人的理性》中呈現的反思。在書中,他聯系人類思想不可簡化(不能把人的思想簡化為邏輯函數,尤其是簡化為ELIZA)這一特性來構建自己的研究框架。[2]這本書提出了合理性與邏輯——尤其是計算機程序和數學公式中能實現的邏輯——之間關系的問題。正如魏岑鮑姆(Weizenbaum,1976:11)所論證的:“把計算機引入我們已然是‘技術社會’的社會……只是強化和放大了先前的那些壓力,這些壓力迫使人對自己的社會采取一種日益高度合理性的看法,并為自己塑造一個越來越機械的形象。”魏岑鮑姆認為,應該對給計算機分配的任務設限。這意味著要為計算的部署建立規范限制,因為計算機會影響人在世界上尋找自身定位的欲望。他擔心計算機嚴格遵循工具編程邏輯時形成對同情或人際尊重的偽裝,認為這種欺騙將會無意間給雙方帶來改變的交流性相遇變成一種造成疏離的接觸。他(Weizenbaum,1972:316)也預見到了對計算機決定提出異議的困難,他寫道:

人不再為“機器說的話”負責。因此,就不存在對錯,不存在正義與否的問題,不存在關于同意或不同意什么的理論。最終,也不存在讓人能夠質疑“機器說的話”的基礎了。

重要的是,我們要開始學著從“后端”操作和“前端”界面這兩個角度來理解這些新的AI系統,因為作為計算系統,它們可能會變得越來越普遍。就像瓦特1776年發明的蒸汽機一樣,AI常被視為具有多種潛在應用的通用技術。因此,我們可以預計,AI的投入使用將對全球經濟產生變革性影響。人們已經在日常語境中使用AI了,如電子郵件的垃圾郵件過濾功能、媒體的推送系統、導航應用以及支付交易的驗證與核實。雖然AI顯然有對社會和個人產生巨大影響的潛力,但描繪這些影響是一項艱巨的任務,特別是考慮到AI領域經常宣揚自己的發現和潛力。[3]從監管的角度來看,AI系統的自主性引發了一系列獨特的問題,涉及責任、保險、公平性、風險與安全,甚至創意內容的所有權。這些問題要求我們深入思考透明性與偏見、基礎設施決策,以及創造、使用和評判它們所需的各種新數字技能。

我們的社會愈發依賴數字技術,這些技術包含了計算合理性(computational rationalities),進而也包含了算計的合理性(calculative rationalities),并且圍繞維持社會學意義上的人類推理能力這一事情提出了諸多挑戰(Berry,2011)。我們對小型軟件應用日益依賴,很快就會出現問題,因為它們是自動化、網絡化的,并且被接入了更大的軟件平臺和服務,這使其運作更加復雜。雖然這些系統中有許多最初是為支持或輔助人們進行大量活動、分析和決策的判斷而設計的,但它們的運行早已超出用戶的理解范圍,可同時它們又不可或缺。這樣,這些設備通過使人類理性的認知過程卷積短路,通過給予某些邏輯進程工具關系特權,改變了人類理性能力。于是,才有了“我們社會中,個體普遍存在的無力感……人們彼此之間、對自己工作的普遍疏離……以及普通人那種生活在龐大系統縫隙中的感覺”(Rosenberg,1980:49)。魏岑鮑姆提出的這些說服、欺騙和中介概念,與后來AI發展軌跡中普遍存在的問題非常契合。

值得注意的是,發達資本主義社會的經濟無政府狀態,與理性化和技術相互交織,這種交織傾向于阻礙反思勞動。在此條件下,工具理性的價值被賦予了特權地位,畢竟其體現于合理性概念本身。將算計和理性思考混為一談,意味著不能被簡化為數的事物都是幻想或形而上學的。結果,社會對批判思想的敏感性可能下降,這也體現為個體化潛能的削弱。在當代計算社會,人們有十足的動力采用理性化的行動與思考方式,也就是插入算法的方式。而轉向使用AI,更確切地說是使用機器學習的自動化系統,會進一步推動這個帶來疏離感的過程。這表明,能夠批判這些系統、避免再次陷入缺乏對系統運行充分依據解釋的抽象行為的解釋性理解極為重要(Berry,2021)。正如魏岑鮑姆所說:“即便大型計算機系統,也不一定不可理解。它們可理解性的秘密在于,這些系統是非常穩健的理論模型。”(Rosenberg,1980:45)

我們對合理性的構想在多大程度上被重新表述為一種將人的思想理解為算計而非判斷的形式,這正是漢娜·阿倫特(Arendt,1972:11)聯系政治決策和政策所研究的內容。阿倫特的研究顯然影響了魏岑鮑姆的思考。[4]他引用阿倫特的話說:“他們(政策制定者和執行者)不僅聰明,還為(自己)‘合理’……而不下判斷感到自豪;他們算計……一種對現實可算計性的從根本上非理性的自信(變成了)決策的主旋律。”(Weizenbaum,1976:14,強調部分為原文所有)。

在同一文本的稍后部分,他又闡述道:

計算機能夠做出司法判決,也能夠做出精神疾病診斷。它們拋硬幣的方式能比最有耐心的人所采用的方式復雜得多。關鍵在于,不應該讓計算機承擔這類任務。在某些情況下,它們甚至能得出“正確的”決定,但這種決定總是且必然建立在沒有人愿意接受的基礎之上。(Weizenbaum,1976:227)

要聯系ELIZA來研究這些問題,思考魏岑鮑姆在設計和編寫該系統時所關注的語境和一些爭論是有幫助的。接下來,我首先要考察魏岑鮑姆開發ELIZA的環境,從而理解他是如何構思界面的可供性(affordances)的;其次,思考ELIZA與現代用生成式AI開發的聊天機器人之間的異同;最后,在結論部分提出關于這種聯系的一些反思,并對魏岑鮑姆提出的警告加以引申。

二、ELIZA和早期的AI

約瑟夫·魏岑鮑姆于1923年1月8日出生在柏林的一個猶太家庭。他的父親是皮草技術員,母親叫亨利埃特。[5]13歲時,他隨父母逃離納粹德國,移民到美國并在底特律生活。他后來說自己“是在恰逢合理性的終極流產的成長歲月進入世界的”(Dembart,1977:1)。雖然他最初在韋恩大學學習數學,但1941年“他因戰爭中斷了學習,其間在空軍氣象部門服役”(Sack,2018)。1946年,他返回大學,并分別于1948年和1950年獲得學士和碩士學位。此后,“他在底特律的韋恩大學參與設計和建造了一臺數字計算機”(MIT,2008)。1955年,他搬到西岸,加入通用電氣公司,與SRI合作開發了一個名為電子記錄機會計(electronic recording machine accounting,ERMA)的銀行自動化系統。[7]ERMA是為幫助美國銀行管理此前一直依靠人工處理的海量紙質支票而開發的。在20世紀50年代初,銀行業在本質上處于危機邊緣:

1943—1952年,美國的支票使用量翻了一番,從每年簽發40億張增長到80億張。銀行家估計,到1955年,支票數量每年將增加近10億張;到1960年,每年簽發的支票數量將高達140億張。(Fisher&McKenney,1993:44)

ERMA系統讓人們能夠利用打印在支票底部的磁編碼字體,借助磁墨水字符識別技術實現支票處理自動化。在向媒體做最終演示時,ERMA還無法完全自動運作,需要一名程序員躲在后面的屋子里幫忙掩蓋系統故障。這種用人來替代當前尚未運行或未完成的算法的技巧,被稱為“奧茲國的巫師”編程。費舍爾、麥肯尼認為:

SRI工程師……以豎大拇指的形式表示系統運行穩定,可繼續演示。在設計周期的早期,這種樣機形式被視為有益,因其提供了研究和了解用戶預期與要求的途徑。莫茲利等人認為,這種方式尤其適合探索待投入使用系統的設計可能性。ERMA的展示很順利,媒體從未質疑(計算機系統)不夠理想。(Fisher & McKenney,1993:55)

萊茵戈爾德(Rheingold,1985:164)認為,“最終將這個過程成功計算機化”是“世界銀行系統計算機化的一個里程碑”。不過,在計算過程中,用欺騙代替算法的引入和使用,使其看起來平穩,以及用人力勞動取代計算機這種做法,預見了魏岑鮑姆后來提出的關于自動化的擔憂。[8]

在通用電氣任職期間,魏岑鮑姆著手開發一個名為對稱列表處理器(symmetriclistprocessor,SLIP)的編程系統,并于1963年完成。SLIP是一組函數,這些函數通過調用例行程序(routines)來執行列表處理,這些例行程序最初由機器代碼編寫,后來用Fortan編程語言編寫。魏岑鮑姆本人將其稱為“FORTEAN/SLIP程序”(Weizenbaum,1963:524)。在離開通用電氣之前,魏岑鮑姆寫過一篇名為《怎樣使計算機看起來智能》(“HowtoMakeaComputerAppearIntelligent”)的揭秘文章。文章引用馬文·明斯基的觀點來論證:一種以特定觀察者無法理解的方式產生結果的活動,在該觀察者看來,在某種程度上是智能的,或者至少有智能的跡象(Weizenbaum,1962:24)。在那篇文章中,魏岑鮑姆還描述了一個“五子棋”游戲,該游戲看似智能,但其底層編程實際上并未編入這種智能:

根據上述推理,“人工智能”程序的作者能在一段時間內愚弄部分觀察者,其成功程度可通過被愚弄的觀察者所占百分比乘以他們未察覺的時長來衡量。(Weizenbaum,1962:24)

1993年,在反思自己工作時,他承認這讓他有了“騙子或老千”的名聲(Crevier,1993:133)。[9]:他覺得:“從某種程度上說,那是我后來開發ELIZA的前身,也讓我有了騙子或老千的名聲。但另一方面,我毫無保留地說了出來。我的想法是創造‘計算機是智能的’這種強烈錯覺。在那篇文章里,我花了很大力氣解釋,幕后沒多少東西,機器并沒有在思考。我把策略解釋得很清楚,任何人都能寫出那個程序,我寫ELIZA時也是如此。”(Creview,1993:133)

基于SLIP方面的工作,1963年,他獲得了麻省理工學院提供的電子工程助理教授職位。四年間,他就拿到了終身教職,于1970年升任計算機科學與工程正教授。[10]在那里,他用密歇根算法解碼器(Michiganalgorithmdecoder,MAD,1959年為IBM7090和相關計算機開發的一種編程語言與編譯器)重寫了SLIP。MAD基于ALGOL語言,但并非ALGOL語言。MAD-SLIP這一術語常被用于指代二者的結合,可實際上,SLIP和MAD始終是分開的,它代表一組可納入MAD程序的列表處理函數。這與長期存在的誤解相反,即ELIZA最初是用LISP而非MADSLIP編寫的。值得注意的是,魏岑鮑姆后來證實,ELIZA是從他1962年編寫的那個游戲發展而來的。[ 11]耶認為:

20世紀60年代中期,魏岑鮑姆在MIT時試圖讓計算機用英語與人交談。他指出,像STUDENT這樣的現有程序應用領域有限,而且描述這些領域的知識與程序結構本身密不可分。魏岑鮑姆還探究了程序通過向用戶提問來獲取更多信息的有限能力:“我很清楚,我們在接下來的幾個星期里解決不了這個問題。”魏岑鮑姆告訴我:“所以我開始思考替代方案……我把我所有的辦法整合起來,做起了ELIZA這個項目。”(Crevier,1993:133134)

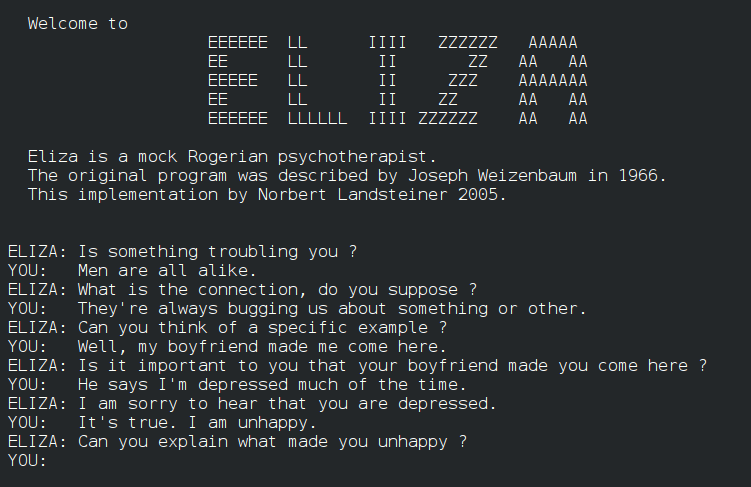

ELIZA試圖以一種相對簡單的方式模擬人與心理治療醫師可能的對話。它有一個互動界面,用戶可通過打字來回答軟件所生成的問題。眾所周知,很多人對它介入對話的能力印象深刻,覺得這個程序具有比實際更多的理解力與智能。寫完ELIZA后,魏岑鮑姆承認:“我沒意識到,極短時間接觸一個相對簡單的計算機程序,也會讓相當正常的人產生強烈的妄想。”(Weizenbaum,1967:7)正如他所解釋的:“選擇這種對話模式,是因為精神科晤談是為數不多的分類二元自然語言交流(categorized dyadic natural language)的例子之一。在這種交流中,參與雙方的其中一方可以自由地擺出對真實世界一無所知的姿態。”(Weizenbaum,1966:42;Boden,1977:108)[12]通過使用簡單的模式匹配技巧,魏岑鮑姆讓ELIZA程序能夠把輸入的英文句子轉變為對用戶而言看起來有意義的輸出。麥考黛克認為:

當時,問答機器在MIT極為火爆。博布洛(Bobrow)在MIT研究STUDENT;拉斐爾(Raphaelb)在做后來的SIR;“棒球”程序則是劍橋地區的成果。魏岑鮑姆趁勢推波助瀾,他連續多日早起,與開發過CO-MIT語言的鄰居維克托·英格維(V.Yngve)一起研究模式匹配。(McCorduck,2004:292)

魏岑鮑姆在ELIZA程序里探究了許多此類問題。ELIZA這個名字源于伊萊莎·杜立德,她是蕭伯納1912年戲劇《皮格馬利翁》(也叫《賣花女》)中的一個工人階級角色。事實上,魏岑鮑姆后來表示,他是偶然觀看了由該戲劇改編、1956年首演且1964年推出電影版的《窈窕淑女》才知曉這個角色的。他為那個后來與ELIZA相混淆的人格腳本所起的名字是DOCTOR。雖然后來這個名字可能一直被視為代表心理治療師的無性名字,但ELIZA延續了這個名字的內涵,將階級、性別乃至種族與族群的社會結構融入程序中——因為ELIZA這個名字包含著蕭伯納戲劇以及20世紀60年代改編的音樂劇中對女性和社會階級的再現所蘊含的假設。

ELIZA會以打字的方式對所有英文輸入做出回應,其腳本DOCTOR旨在模擬或“戲仿”一位羅杰斯學派心理治療師。羅杰斯學派心理治療由心理學家卡爾·羅杰斯于20世紀40年代創立,采用一種鼓勵患者多說話的非指導性語言方法。魏岑鮑姆將這種方法用作構建ELIZA回應的模型,ELIZA的回應大多是重復用戶先前對話文本輸入中的關鍵問題。魏岑鮑姆(Weizenbaum,1967:474)將ELIZA描述為“后來被稱作DOCTOR的程序家族中的第一個程序……一個特殊成員。這些程序的家族姓氏也是ELIZA”。這組程序是在麻省理工學院的一臺IBM計算機上用MADSLIP創建的,發布時只有一個一般性描述(Weizenbaum,1966;Weizenbaum,1967)。在描述程序如何解析句子時,魏岑鮑姆寫道:

從左至右掃描輸入的句子,在關鍵詞詞典里查找各個詞。若某個詞被識別為關鍵詞(除關鍵詞優先級問題外),則只需嘗試包含該關鍵詞的分解規則。(Weizenbaum,1966:38)

他接著詳細闡述了特定關鍵詞為何需要特殊處理:通常,當一個人使用像“每個人”“總是”或“沒有人”這樣的全稱術語講話時,實際上指的是某個非常具體的事件或人物。賦予“每個人”比“我”更高的優先級,就能生成“具體說說你想到的是誰”這樣的回應(Weizenbaum,1966:39)。

魏岑鮑姆還提供了一個用于說明關鍵詞檢測的基本流程圖,并描述了一些衡量關鍵詞的具體算法:

魏岑鮑姆決定把領域知識放入一個與處理對話的程序模塊相分離的模塊。他推斷,如果用不同的知識模塊(他稱之為“腳本”)來描述不同種類的知識,程序就能談論各種各樣的話題。今天想談高級時裝而非棒球?只要加載高級時裝的軟件模塊即可!由于程序會像蕭伯納《皮格馬利翁》中的伊萊莎·杜立德那樣,學著把話說得越來越好,因此魏岑鮑姆將程序命名為《伊萊莎·杜立德》。(魏岑鮑姆后來指出,另一個原因是,“和杜立德小姐一樣,它永遠不清楚自己是否變得更聰明了”。)(Crevier,1993:134)

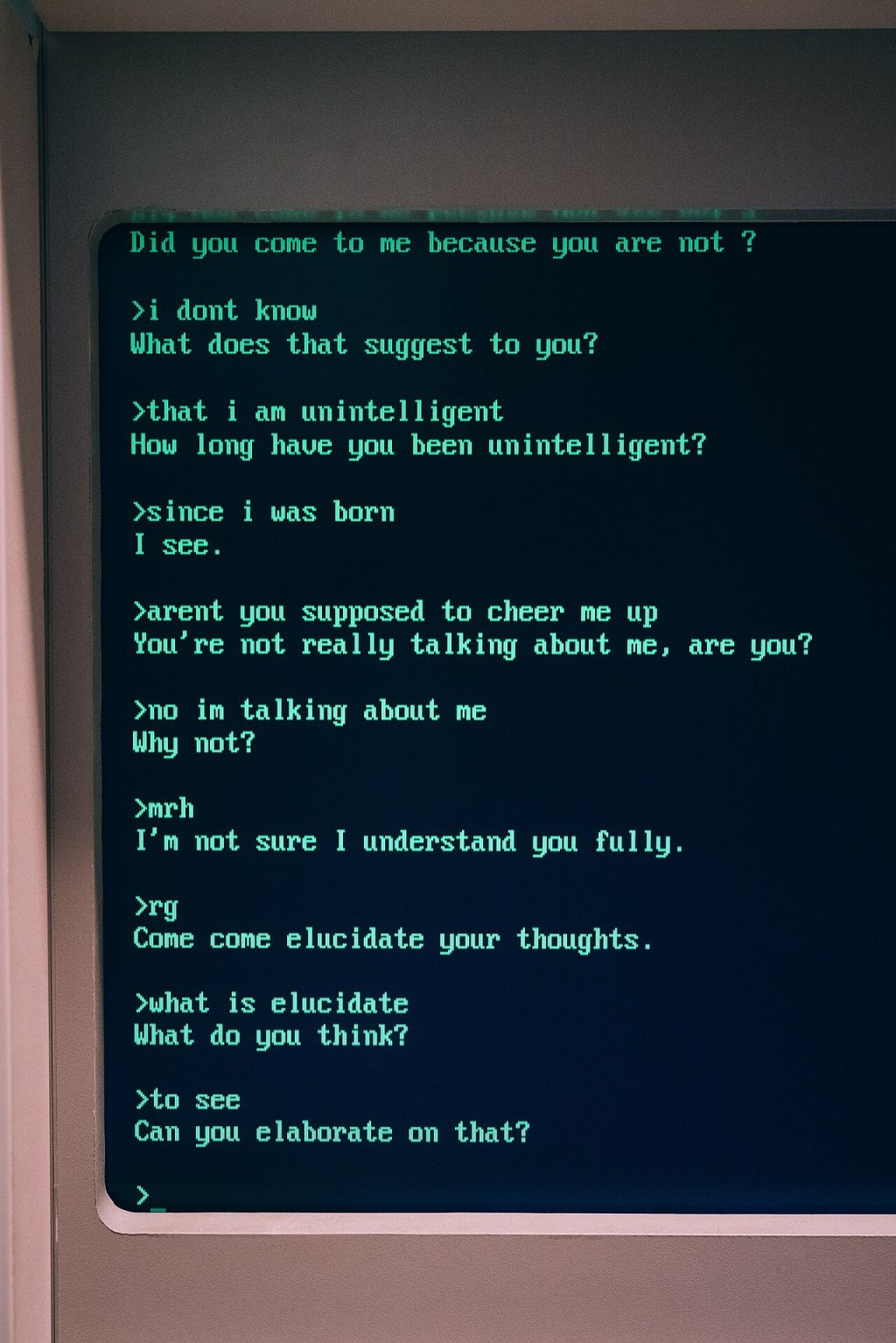

與Eliza對話

三、ELIZA的社會意義

通過開發ELIZA程序和DOCTOR腳本,魏岑鮑姆揭示了一點:就計算與人的行為和理性的聯系而言,它會帶來深刻的影響。魏岑鮑姆試圖對這些影響進行探索、提出異議并加以限制:

我驚訝地看到,與DOCTOR對話的人迅速對計算機產生了深厚的感情,并且毫不猶豫地將其擬人化……這表明,人們以這種方式與計算機對話,就好像它是一個能夠與之用親密的語言恰當、有效地交談的人。(Weizenbaum,1976:6)

事實上,人們傾向于對計算機投入私人情感,這讓魏岑鮑姆感到困惑與擔憂。他擔心機器可能取代人們內心的現實,還擔心計算機也許會讓“相當正常的人產生強烈的妄想”,并且強化那些將合理性與算計聯系起來、認為人就是機器的想法。這便是后來所謂的“ELIZA效應”,也就是人認為計算機系統有理解力和智能的傾向。侯世達(Hofstadter,1995:167)在1995年將其描述為“人的這樣一種易感性:人們很容易從計算機串聯的字符串(尤其是文字串)中讀出遠超應有的理解”,這個極具說服力的描述也能精確地描述現代的生成式AI系統(如ChatGPT):

在這里,我們要記住,魏岑鮑姆版的DOCTOR不是在屏幕上一閃而過,而是或多或少被永久地印在紙上。我們可能會把該系統理解為受到文學和心理治療影響的系統,留下打印記錄(如日記)的治療過程,給人的體驗或許和在屏幕上的短暫接觸有所不同。(Montfort,2004)

的確,如今我們更熟悉出現在屏幕上(無論是臺式電腦、筆記本電腦、智能手機還是平板電腦)的ELIZA。但在20世紀60年代,計算機系統幾乎總是使用電傳打字機將輸出打印在紙上。這種“屏幕的缺失”,是理解當時計算機的物質特性以及使用系統體驗的關鍵。顯然,ELIZA捕捉到了一種思維模式,以及我們與計算機關系中的一種焦慮。魏岑鮑姆后來也通過對自身工作的哲學、社會和政治基礎(我們也是基于此理解他的工作的)進行批判性考察,探索了這種思維模式和焦慮。還需指出的是,軟件是一種動態且不斷變化的媒介,軟件程序很少只有一個版本。實際上,在編程過程中常常會出現多個相互矛盾的副本:

值得注意的是,ELIZA存在多個版本。魏岑鮑姆承認自己一直在對ELIZA進行改進,因為“最初的ELIZA除了生成似是而非的回應外,做其他任何事都很困難”。他在1967年寫到,后來的版本與舊版本主要有兩方面的不同:其一,它包含一個求值器,這個求值器能夠接受無限復雜的表達式(程序)并對其求值(執行),當然也能夠將求值結果儲存起來,以供后續檢索和使用;其二,腳本的概念得到了擴展,現在程序可以同時包含三個不同的腳本,能夠從磁盤存儲單元中無限量供應的腳本里獲取新腳本,并且現有的腳本之間還可以相互通信。(Weizenbaum,1976:478)

遺憾的是,這些后續的改進缺乏充分的記錄,許多源代碼仍然處于丟失狀態。不過,如今人們已經從MIT檔案中恢復了ELIZA的源代碼列表以及1966年的一些腳本。[13]

作為計劃的一部分,我也參與了重建ELIZA代碼的工作。我們已經確定,ELIZA實際上至少有五個主要版本。其中三個版本已被遺忘(并且可能已經丟失),還有一個最終版本只在其他檔案的文字資料中被提及。按照年代順序,我們暫時識別出以下版本:

1.ELIZA1965a:僅以“.”和“,”分隔句子(證據源于MIT檔案流程圖)。

2.ELIZA1965b:用“.”“,”和“但是”來分隔句子,缺乏NEWKEY函數,包含未被記錄過的CHANGE函數以及硬編碼信息(這是從MIT檔案中恢復的版本)。

3.ELIZA1966CACM:包括NEWKEY函數、關鍵詞堆棧和“but”分隔符。

4.ELIZA1967:添加了復雜的腳本處理,證據不僅來自魏岑鮑姆和泰勒的描述,也見于檔案中現存的ARITHM、F29、FIGURE腳本。

5.ELIZA1968+:對這個版本的計劃描述見于泰勒。不過,腳本SPACKS、INTRVW和FVP1也證明,在更為復雜的編程中,通過瓦爾特·丹尼爾(W.Daniel)開發的腳本文本,使用過這個版本。

魏岑鮑姆認為,ELIZA開啟了人類依賴和信任計算機的先河,而未來這樣的例子還會越來越多。然而,這只是更大問題的一個元素而已,這個問題就是:

科學向人類許諾了權力。但就像在人類被權力的許諾誘惑時經常發生的那樣,他事先就開始并且在整個過程中都在付出代價,而實際付出的代價,是奴役和無能。權力如果不是選擇的權力,那它就什么也不是。工具理性可以做決定,但決定和選擇完全不一樣。(Weizenbaum,1976:259)

當時,人們圍繞ELIZA和PARRY展開了激烈的爭論——RRY是由肯尼斯·科爾比(K.Colby)于1972年設計的一個競品系統(關于二者的結合,參看Cerf,1973)。科爾比試圖創造一個具有偏執型精神分裂癥特征的聊天機器人,這在當時引發了巨大的爭議,并引起了人們對這類軟件意義的廣泛關注,這些爭論也繼續影響著當代圍繞聊天機器人和AI的討論。

ELIZA提出的問題在大眾文化中得到了更廣泛的響應。例如,“火象劇場”(The Firesign Theater)在1971年的專輯《我認為我們都是這輛巴士上的笨蛋》(I Think We're All Bozos on This Bus)中虛構了它的各種可能性。在這張專輯中,主人公克萊姆去“未來博覽會”參觀,在那里,他與一臺用模糊、聽起來積極且與提出的問題幾乎無關的回復來回答的計算機交談。當克萊姆(他的名字被博覽會的人格化系統錯聽成“阿克萊姆”)有機會提問時,他決定黑掉它,通過說“這是工作人員在說話。你好……”進入系統的維護模式;那臺名叫DOCTOR MEMORY的計算機用“系統狀態:運行時間”和運行時長來響應他。接著,克萊姆試圖通過提出無法理解,有時甚至無法解析的問題來使系統混亂,從而使系統崩潰。最后,克萊姆問:“為什么粥鳥要在空中下蛋?”這使得系統停止服務并關閉。這張專輯中出現了一個類似于ELIZA的系統,這讓許多懂行的人好奇,這樣內行的技術行話怎么會出現在一張喜劇專輯上。這一直是一個謎,直到2015年,“火象劇場”最初的成員之一菲利普·普洛克特在Quora上用一條評論解釋說:“我(那張專輯里)所有的計算機語言,都是從我在洛杉磯工作博覽會上找到的一張人們與ELIZA心理治療師程序互動的打印資料上學來的。”(Proctor,2015)

蘋果的iPhone的AI聊天機器人Siri后來也提到了這個“大眾文化時刻”,它會用“你好阿克萊姆,我能為你執行什么功能?”來回答“這是工作人員在說話。你好……”[14]是怎么被放進Siri的,根據普洛克特的說法,是“史蒂夫·喬布斯在皮克斯一部普洛克特擔任配音演員的電影放映會上遇到他,告訴他自己是‘火象的忠實粉絲’,并要求把這個橋段加入Siri”(Tannenbaum,2015)。[15]這里所展示的,在這些例子中,ELIZA的影響和它提出的問題,從技術領域轉移到了文化領域,并加劇了智能機器出現給公眾帶來的不安。[16]

在魏岑鮑姆1966年的文章發表后不久,伯尼·科賽爾(B.Cosell)就用LISP編寫了一個ELIZA程序。這個程序以魏岑鮑姆公布的算法為基礎,不過重要的是,科賽爾并未見過實際的MADSLIP源代碼。LISP很快成為AI的主要語言,而魏岑鮑姆的DOCTOR腳本格式正是LISP的符號表達方式。此外,ELIZA的原始版本僅在學術圈小范圍流傳,這些因素很可能加深了那個長期存在的誤解,即ELIZA一開始就是用LISP編寫的。需要注意的是,科賽爾的代碼也未曾廣泛公布,而且該代碼直到2013年才被恢復。科賽爾最著名的版本是1966年的那一版,GNU的EMACS版和杰夫·施拉格(J.Shrager)的BASIC版都是基于此版本編寫的。后者最初發布于1973年,1977年由《創意計算雜志》(Creative Computing magazine)再版。[17]施拉格的ELIZA很短,能夠快速手動重新鍵入,并且可以在任何支持BASIC語言(當時這種情況很常見)的個人計算機上運行(North,1977)。如今,多個系統上仍然存在類似的程序,包括手機版和能在網頁瀏覽器上運行的Java版。這些版本就運行的程序語言而言稍有不同,并且僅在長度上存在差異—科賽爾的LISP版包含2500行代碼,施拉格的BASIC程序僅有250行,其他版本則介于兩者之間。[18]

魏岑鮑姆后來在《計算機的力量和人的理性》中繼續闡述操縱和誤認的危險。在該書中,他認為計算機會給人類用戶帶來無法預見的負面影響。魏岑鮑姆早期有將人的工作自動化(如用計算機器取代銀行職員)的經驗,這影響了他日后對計算機給社會帶來挑戰的理解。魏岑鮑姆尤其擔心人的理性會被有效的程序所取代。對他而言,有效的程序是一種操作,這種操作能讓我們在形式數學里定義一個問題域,使該問題域能被機器進行后續計算。而這種思想的形式化又為將人類生活的各方面貶低為機器程序(如把計算當作思考)創造了條件,引出大多數人的這一問題:

根本不理解計算機。所以,除非他們有很強的懷疑能力……否則就只能運用自己能想到的唯一一個類比,即按照自己的思考能力為模型,來解釋計算機的智力壯舉。(Weizenbaum,1976:10)

也就是說,存在一個共同假設:計算機對行為的抽象有助于解釋機器的運作。在當代計算社會中,人們有充分的動力采用理性化、插入算法的行動和思維方式,自魏岑鮑姆寫下相關文字以來,這種動力有增無減。例如,引入可測量的性能指標和輸出標準,以及以計算為前提的監控和監視。我們還發現,在資本主義社會中,相較于互動(對話),常規工作反而增多了。同樣嚴重的是算法系統缺乏合法性,部分原因在于,這些系統在加劇與民主權威相關的結構問題(包括它們在通信和媒體系統中日益廣泛的部署)的同時,自身仍然不透明,它們不斷增強的影響力表明,它們有可能產生系統性危害,造成危險的系統故障(Berry,2014)。也許,只要稍微回顧一下2008—2011年的美國次貸危機,就能發現與理性化和計算相結合的“算計式理性”(calculativereason)與以利潤為導向的公司和個人會形成多么令人頭疼的組合。魏岑鮑姆敏銳地察覺到了這些問題,并試圖闡明其中的重要議題,他評論道:“我們的社會對計算機系統(最初,我們只想讓它們‘幫助’人們進行分析和決策)的依賴日益加深,早已超出用戶的理解范圍,并且對用戶來說變得不可或缺(……這)是一個非常嚴重的發展。”(Weizenbaum,1976:236)

在這里,魏岑鮑姆所指的是算法化帶來的物化與形式化,以及我們構建系統的方式。在創建系統時,人們不再確切知曉或理解系統的運作及決策方式。這就產生了一種危險:因害怕未知的后果,我們不愿修正系統。這進而引出了增強技術所體現和支持的人的主體間歷史概念的創造與維持問題。魏岑鮑姆1976年的評論就觸及了這一點,他說:“《紐約時報》已經開始建立一個實時數據庫……這離讓系統來判定什么算事實,進而直接宣布其他所有知識、所有記憶不合法還有多遠呢?”(Weizenbaum,1976:238)在復雜系統、龐大的數據集合與快速流動的數據流之間進行協調的能力,為社會將“規模”作為一個新的智識視域來運用提供了條件。在業界和知識界的研究中可以看到,人們越來越多地運用計算系統對復雜的“大數據”現象進行抽象、簡化和可視化處理,并且傾向于使用過于簡單化的因果和統計模型來理解復雜的社會現象,“社會物理學”概念就是一個例證(Pentland,2015)。魏岑鮑姆可能會評論說,這種“技術、政治和社會的不可避免性”的混合,“對良知來說是一種強大的鎮靜劑”,它不但賦予計算決定的權力,還賦予其行動的權力(Weizenbaum,1976:241)。

魏岑鮑姆依據他和ELIZA及其他系統打交道的經驗論證稱,我們必須對人工智能及其技術發展持批判態度,如此才能理解當下的處境,并且防止其失控:

我不太清楚計算機科學及其分支學科(AI)是否尤其偏愛委婉。我們如此夸張又欣然地談論能理解、能觀看、能決定、能下判斷等的計算機系統,卻不承認自己在這些概念上的淺薄與極度的天真。而且,在這樣的談論過程中,我們麻痹了評估自身工作質量的能力,更重要的是,麻痹了識別和認知其最終用途的能力。(Weizenbaum,1987:44)

人類與 ELIZA 的 DOCTOR 之間的對話

四、現代的迭代

魏岑鮑姆指出,人的思想和勞動自動化存在危險。這要求我們以一種拒絕忽視和平息現象層面的矛盾及矛盾主張、努力把握主體動態時刻(dynamicmoment)的方式來解釋。這種解釋方式要始終為批判反思理解算法的歷史和傳統留出空間,接受傳統意義結構的重要性,同時力求避免將其理想化。也就是說,在這些計算社會中,傳統可能繼續表現為基于欺騙和扭曲的互動,而這種互動往往會被不加反思地轉換為算法形式,用魏岑鮑姆的話來說:

我們所討論的各種系統的程序都具備一些非常重要的特征:從某種意義上說,它們都很簡單;它們都會扭曲和濫用語言;在否認規范內容的同時,它們也都支持一種基于專業知識的威權主義。(Weizenbaum,1976:248)

現在,為進一步強調這點,我想簡要考察一個例子,它將說明ELIZA的界面可能性與我們對計算機功能的預期為何可能以極其反人類的方式互動。在這個例子里,社會沖突內嵌于算法機器,勞動通過界面被轉化為一種商品。這個例子就是用于隱藏社會勞動,使工人隱藏在網頁表單、聊天機器人和應用程序接口(這些能讓雇主將自己視為創新技術的建造者,而非不關心工作條件的老板)背后的計算(Irani&Silberman,2013:613)。在此語境下,算法造就的“自由”和“創造”可能實際上只是掩蓋了控制和管理系統而已。

為理解社會沖突如何隱藏于算法形式之中,研究在新計算技術條件下才成為可能的現代生成式AI系統(或聊天機器人)是有益的。從某種意義上講,這是“大腦之間的合作”。斯蒂格勒(Stiegler,2010:47)指出,這種合作“通過語法化系統產生,該系統使神經系統活動最高水平上的所有質性任務的無產階級化成為可能”。關鍵是,這是對勞動力的實時抽象,將勞動力抽象為一種潛能,一種像電力或水一樣按需持續供應的“勞動力流”。經由聊天機器人和應用的調節,這種抽象造就了一種高度異化的勞動力。從某種意義上說,這種勞動力實現了控制論系統,該系統試圖在緊密聯系的反饋回路中讓機器與人緊密耦合。這也描繪了魏岑鮑姆在《計算機的力量和人的理性》中所警告的威脅。

這方面的范例當屬OpenAI的ChatGPT。該公司首席執行官稱ChatGPT能改變資本主義:“技術的改進及其對社會的積極影響將持續指數級增長。”(Konrad&Cai,2023)ChatGPT是基于生成式預訓練Transformer模型[大語言模型(LLM)的一種]的聊天機器人,LMM是基于真實對話、文本以及像Reddit那樣的平臺上的文章訓練而成的。它讓當代觀察者感到驚奇,因為通過輸入和問題來提示系統,它似乎將書面文本的生產機械化了。同時,系統的力量實際上隱藏在聊天機器人的“界面”之后。這種既通過軟件匯集人類文化生產,又將其作為計算系統儲備資源的想法,體現了魏岑鮑姆有先見之明地警示過的計算社會中流行的控制論思想。從很多方面來看,這使人類活動變得離散。不過,這也是人通過用于協調更普遍文化生產的計算層的非人化。它還表明界面如何將表面之下進行的社會勞動物化,從而使機器能夠真正將數百萬人類寫作和對話的痕跡據為己有,而這一切都是人們沒有意識到且未曾同意的。

這也開啟了按需求進行管理、控制、監控、分解與再集合的自動化文化生產的可能性。資本主義公司將其操作化后,就有造成社會休克的危險,因為新的技術實踐往往能避開勞動法與勞動保護的監管,還能帶來巨大利潤。

這可能扭曲更廣泛的經濟,這是缺乏政府監管和工會等勞動組織監督的結果。或許我們還會發現,未來的社會沖突與這種自動化系統的擴大使用有關。實際上,它們營造出一種算法拜物教的感覺,勞動被算法掩蓋,這意味著通過面板界面和編程代碼互動的程序員或用戶無須承認勞動的社會性。對界面另一邊的工人來說,對能動性、體力勞動、情感控制和自我規訓的要求可能造成嚴重的心理緊張(在失范與宿命論之間切換)。消費者或客戶的一條差評就可能立即導致失業,而且資方幾乎不會給出解雇原因。這是否會為必要性政治和社會學反身性創造條件還有待觀察,但它肯定是傳統工人階級之外未來勞動祛魅的一個可能來源。我們在當前流行的基于文本界面的聊天機器人中也能看到類似的例子。和ELIZA一樣,這些聊天機器人也是部分自動化、部分由人來管理客戶的詢問和問題(Marino,2006)。不用說,ELIZA啟發創造認知工廠的計算系統這一想法會讓魏岑鮑姆感到恐懼。

通過使用這種新范式,運用生成式AI的系統指出了新一類知識—權力化界面的各種可能性。在此,機器被界面模糊,它可能是人類勞動、聊天機器人或者其他形式的AI。從界面用戶的視角看,沒有任何差別。這個程序將關系物化,在用戶與底層過程之間創造出一種命令—執行關系。對手段的模糊(不論它可能編碼何種剝削關系)以及在計算系統中對真實人類進行理性化和抽象所帶來的后果,也讓人聯想到魏岑鮑姆1976年的評論:

當個體不被當作完整的人來對待時,就被非人化了。各種形式的人類和社會工程……在繞過人的語境,尤其是繞開那些賦予人的語言以真實意義的語境時,就在做這樣的事。(Weizenbaum,1976:266)

五、關于生成式AI意義的反思

通過考察先前有關早期計算的論證和討論,我們找到了一種反思當下困境與問題的有用方式,這些困境與問題出現在我們急于將社會合理化和計算機化之時。身為計算科學家,魏岑鮑姆樂于反思自己的實踐及其工作的意義:

這應該教會我們什么呢?特別是就至少保住甚至增加人在人類事務中的選擇這一問題而言。當然是,與其說構建可靠的計算機軟件依靠計算機科學的研究成果,不如說是對人類狀況更深入的理論理解。(Rosenberg,1980:103)

雖然ELIZA放在今天或許顯得原始,但它仍反映出諸多設計決策,這些決策在我們如今使用的系統中依舊有所體現,比如人機如何互動,以及應在多大程度上允許計算管理我們的生活與心智等。它還表明,早期軟件的發展脈絡對于理解我們在何種程度上必須始終對過去的假設以及技術可能且應該如何發展的想法保持質疑非常關鍵。雖然如今我們不會把ELIZA視為AI(即便過去我們曾有過這種錯誤認知),但我們也應認識到,類似的工具合理性仍然內置于機器學習和當今的AI系統之中。

今天的計算機科學環境與魏岑鮑姆當時的環境有實質性不同。他在學院環境下工作,雖得到美國國防部MAC計劃的項目資助,卻從實驗研究視角探索技術(如ELIZA)。如今,AI日益被資本主義需求所涵蓋(Berry,2021;McQuillan,2023)。多數AI的發展趨向計算的歷史規范,包括強調技術層面將控制與執行分開的能力。計算的批判史顯示,這種方法常被用于與資本主義相符的進程,其中隱含一套假設,如在構建社會關系時對市場優先性的先驗假設。其次——在我看來與之不無關聯——當前理解AI的方式傾向于促使人們對其運作進行形而上學或形式主義的辯護與解釋。這可能使思想的數學化成為一種價值,在這種價值觀念下,思想的形式化不僅是思考AI的一種方式,而且是唯一可效仿的方式。這可能催生一種傾向于理念論,卻不關注誰擁有和控制新“認知手段”的計算理論,就如布萊茲·帕斯卡爾在17世紀評論的那樣:

數學的心智(esprit de geométrie,幾何學精神)和直覺的心智(esprit de finesse,敏感性精神)是存在差別的。數學家不講直覺,原因在于他們看不到眼前的事物。他們習慣了明確、顯而易見的數學原理,習慣在正確理解和處理原理之前就得出結論,所以在需要直覺的問題中就會迷失。在這類問題里,原理不能像之前那樣被處理……這些事物極為微妙且眾多,需要一種非常微妙和精確的性情去感受它們,然后依據這種感知做出準確、正確的判斷。最常見的情況是,我們無法像在數學中那樣從邏輯上對其進行證明,因為我們認識原理的方式不同,那樣做會是一項無盡的任務。“真”必須直接去看,一眼便知,至少在一定程度上不需要通過推理過程。所以,數學家很少按直覺行事,憑直覺行事的人也很少是數學家。因為數學家想用數學的方式處理直覺方面的事物,他們荒謬地想從定義開始,再按照原理……倒不是說心智不會這么做,而是說,心智會沉默、自然而簡單地這樣做。(Pascal,1995:151,譯文有改動)

在不否認人文學科或社會科學對AI或機器學習的研究方法尚不成熟的情況下,我想魏岑鮑姆會認同,AI思考中的嚴重問題確切地說正是這樣一個假設:數學化或形式化是理解的前提。畢竟,魏岑鮑姆本人解釋過:

他們一開始可能只是相信,自己采用的運算不過是在描述所處理現象時一種便捷的速記方式。但隨著他們用從外部語境借來的基本要素構建出越來越龐大的概念框架,為這些框架命名,并且像操控更復雜思想體系的元素一樣操控它們,這些框架就不再僅僅是描述方式了,而是像馬斯洛的錘子一樣,成為他們世界觀的規定。(Weizenbaum,1976:102)

隨著以ChatGPT這類系統為代表的機器學習不斷進步,人類思維能力被毀滅這一危險(可能會被誤解為只是AI偶然的副作用)已隨之而來了。不過,對于任何技術而言,在創造技術、應用技術以及圍繞技術在社會中的使用進行限制和管制方面,人類總有選擇。魏岑鮑姆富有先見之明地認識到,無知、無意義的機器可能會對我們的理解能力、主體間交流能力以及基本人性構成挑戰。他發現人類對彼此存在自然的同理心,也明白這種同理心可能會被錯誤地導向計算機,還認識到對于技術主義者來說,利用這種同理心誤導或欺騙人們以謀取利益、煽動或說服他們,乃至破壞民主本身具有巨大的誘惑。我們正生活在ELIZA所指向,而魏岑鮑姆試圖警示的未來。現在,聽從他的警告,明確可計算事物的限度是我們的責任。[20]

首先,魏岑鮑姆開發ELIZA的初衷是探索計算機與人類交互的可能性。在當時的技術環境下,這是一項極具開創性的工作。他的貢獻不僅在于創造了一個可模擬對話的程序,更在于引發了人們對人工智能本質的深入思考。

在生成式AI(如ChatGPT)蓬勃發展的當下,魏岑鮑姆批判性更強的著作顯得格外重要。他曾警示過過度依賴人工智能可能產生的風險,像人機關系失衡以及對人類思維方式的潛在影響等。ELIZA雖是較為初級的程序,卻已展現出計算機模擬人類對話的潛力,當代的機器學習和AI技術更是將這種潛力發揮到了新高度。

ELIZA相關討論為當下機器學習與AI的爭論提供了獨特視角。一方面,ELIZA使人們認識到計算機在一定程度上能模仿人類語言行為,這為機器學習奠定了早期理論與實踐基礎;另一方面,人們也意識到僅追求語言相似性并不代表計算機具備人類智能。比如,ELIZA的回應常基于預設模式和算法,缺乏真正的理解與情感。

當代,生成式AI面臨諸多挑戰與爭議,如數據隱私、算法偏見、對就業市場的沖擊等。魏岑鮑姆的思想能引導我們更謹慎對待這些發展。我們不能只陶醉于AI帶來的便利和高效中,還得關注其背后可能潛藏的風險。同時,對于AI的發展方向,我們應更注重讓其與人類社會更好地融合,而非單純追求技術超越。

總之,考察魏岑鮑姆對AI的貢獻并討論ELIZA,有助于我們更好地理解當前機器學習和AI發展中的關鍵問題,從而在這個快速發展的領域保持清醒頭腦,引導AI朝著對人類有益的方向發展。

注釋

[1]作為一個 2021 年形成的國際研究團隊的一部分 ,我們已經在 MIT 檔案館中重新發現了 ELIZA 丟失的用 MAD/SLIP 語言編寫的代碼 。關于這一進展的細節已經發布于 ELIZA 檔案網站 ,參見 https://sites. google. com/view/elizagen-org/the-original-eliza。

[2] 在這里 ,我們可以指出計算系統(尤其是聊天機器人,不管是 ELIZA 還是當代如 Siri 那樣的界面)的性別化(更完整的討論可參看 Marino , 2006)。

[3] 在我看來,就技術的變革潛能來說,當前的機器學習和 AI 系統能夠把人在當代數字基礎設施、 數字應用和數字過程中不得不做的“無聊之事”自動化,這一事實比說它們有“創造力”或者能使文化自動化更具說服力。

[4] 魏岑鮑姆提及劉易斯·芒福德、漢娜 ·阿倫特、雅克·埃呂爾、西奧多 · 羅斯扎克、肯尼斯 · 博爾丁,稱這些人表達了“對科學技術肆意發展所造就狀況的深切關注”(Weizenbaum, 1976 : 11)。 魏岑鮑姆在《計算機的力量和人的理性》里指出,出版前劉易斯 ·芒福德“通讀了全書”(Weizenbaum, 1976 : x)。

[5] 魏岑鮑姆2008 年3月5日去世于德國。

[6] 魏岑鮑姆解釋說 :“促使我投身數學的是……在所有可學的東西里,數學看起來是最容易的。 數學就像一場游戲,完全是抽象的 。在認為數學最容易這一認識背后,隱藏著與之對應的一種認識,即真實生活是最難的。我從孩童時期起就這么認為了。”(Dembart, 1977)

[7] SRI國際是斯坦福大學于1946年創立的一家非營利公司,原名為斯坦福研究中心 。1970 年,SRI脫離大學獨立 ,于1974年更名為SRI國際,且越來越聚焦于國際事務(SRI International, 2016)。

[8]考慮到魏岑鮑姆于1955年或1956年加入這家公司,他是否出席了ERMA的發布并不明確。魏岑鮑姆不在費舍爾和麥肯尼所列的主要工程師或貢獻者名單上,但他仍有可能聽說過那種騙術,即通過在計算機和演示者之間安排一名工程師來假裝直接操作計算機。

[9]我們不禁好奇,魏岑鮑姆是否讀過大衛 ·毛雷爾(D. Maurer)1940年出版的《大老千》(The Big Con) 。毛雷爾后來寫到,如今,騙子不會再背著一大堆事先寫好、涵蓋所有可能情況發展的腳本到處跑了,他們什么都不寫 。不過,他們憑經驗就能知道可能出現的情況,也知道他們的臺詞應對這些情況是完美的 。所以,如果內鬼提供了一間辦公室 ,那么就有很多常備的應變方式。騙局的所有參與者都牢記這些應變方式,并且能根據給定的信號采用相應的應變方式(Maurer, 1974 : 89; Weil, 2015) 。很難想象有比這更好的對ELIZA的描述了。有趣的是,魏岑鮑姆也在《計算機的力量和人的理性》(Weizen- baum, 1976 : 121) 中收錄了一小段關于“騙子”的離題討論。

[10] 魏岑鮑姆后來先后在哈佛大學教育研究生院、斯坦福大學、柏林工業大學以及德國漢堡大學任職 。他還是美國科學促進會會員、紐約科學院和歐洲科學院成員(MIT , 2008)。

[11]魏岑鮑姆( Weizenbaum , 1962) 所描述的游戲其實是五子棋,而非跳棋 。薩繆爾在談及“機器學習”時暗示了跳棋,但未直接引用(Samuel , 1959) 。不過 ,魏岑鮑姆確實參考過香農關于象棋的作品 ( Shannon , 1950 ; McCarthy , Minsky & Rochester et al. , 2006) ,而且很可能受到薩繆爾1959年那篇文章的影響。

[12]有趣的是,魏岑鮑姆在一次訪談中稱,他“一開始構想 ELIZA 為一名酒保,但后來覺得心理治療師更有趣”( Crevier , 1993 : 136) 。

[13]除DOCTOR外,MIT檔案中的腳本如下:ARITHM(可進行對話中的數學計算,求值并返回結果)、F29(似乎是FIGURE數學定義腳本的早期版本)、FIGURE(像是 F29 加上更多定義和回應后的拓展版本)、GIRL(簡單演示腳本)、NEWENG(用于討論新英格蘭各州) 。有腳本輸出但無腳本本身的有 : ELEVTR(討論電梯物理學)、POLETA(討論“竿與谷倉悖論”)、SPACKS(討論MIT人文系引用的貝利·斯帕克斯的一句詩)、SYNCTA(討論時間同步腳本的名稱) 。檔案中還提及一些既無腳本也無腳 本輸出的腳本:ANTIPR、INTRVW(據描述是為四向量研究做準備的初步采訪)、FVP1、FVQUIZ、CANVEC、FRANCE、FORVEC、MIT、ORTH1、PHOTON、RLPOLN、STATES、QMPROB、WATSNU、XYPOLN。 相關重建工作可參看 https://wg. criticalcodestudies. com/index. php? p =/discus-sion/108/the-original-el- iza-in-mad-slip-2022-code-critique。

[14]可惜的是,這個彩蛋在過去幾年間的某個時候被移除了。

[15]最近的對話界面(也被稱為可聽界面)復制了 ELIZA 的諸多特征 。這一情況在約翰 ·凱萊(J. Caylay) 的《聆聽者》(The Listeners) 中也有體現 。它是在揚聲器或通過揚聲器訪問的用戶與Amazon Echo之間進行的語言表演、裝置,是由亞馬遜分發的第三方應用。

[16]最近,ELIZA又出現在阿德里安 ·柴可夫斯基(A. Tchaikowsky)2015年的科幻小說《 時間之子》(Children of Time)里了。

[17]理查德 ·斯托曼( R. Stallman) 一直被視作GNU的EMACS版ELIZA的作者,但斯托曼告訴我,他并未編寫過這個程序(個人通信 ,2022年11月13日) 。

[18]DOCTOR是伯尼 ·科賽爾依照魏岑鮑姆在期刊文章中的描述編寫的LISP版ELIZA 。伯尼 · 科賽爾是 BBN( Bolt Beranek and Newman) 科技公司程序員團隊成員之一 。1972 年,該團隊制造出兩臺用作ARPANET通信路由的專用計算機,名為接口信息處理機(Interface Message Processor,IMP) 。1972年9月,文頓 ·瑟夫( V. Cerf) 錄制了 DOCTOR和PARRY的一次對話,并于1973 年將結果記錄為征求評論稿(Cerf , 1973) 。

[19]我要感謝2016年與2022年的批判代碼研究工作團隊(Critical Code Studies Working Group) ,他們對ELIZA展開的豐富且詳盡的討論,極大地啟發了我對 ELIZA 和 DOCTOR的思考。

[20]在這里,我對“不可計算的東西”的理解,是從哪類問題適合計算的批判意義出發的,而非依據關于什么能或不能被算法再現的更具技術性的定義。在此語境下,不可計算的東西就是被社會定義為不適合計算的那些問題。

(參考資料從略)

- 报料热线: 021-962866

- 报料邮箱: news@thepaper.cn

互联网新闻信息服务许可证:31120170006

增值电信业务经营许可证:沪B2-2017116

© 2014-2025 上海东方报业有限公司