- +1

315實測|AI新型詐騙頻發,如何用AI工具解套防詐

在 Sora、Claude 3 將人工智能推向新高峰時,人工智能的觸手也被拿來伸向黑暗。

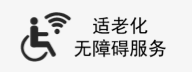

澎湃新聞對齊 Lab 梳理近期 AI 新型詐騙典型案例后發現:當下利用 AI 技術的詐騙手段呈現出門檻更低,效果更逼真的趨勢,讓人更加防不勝防。

面對 AI 新型騙局的各類場景,我們應該如何提高防范意識和應對能力?

AI 換臉視頻:三招解套防詐騙

2023 年 6 月 10 日,國家反詐中心辟謠“AI 詐騙在全國爆發”,確認全國 AI 詐騙實施不超過 10 起,主要是提前制作了換臉視頻,并不是實時的視頻互動通話。而新近的案例中,我們發現在視頻通話中利用 AI 換臉的案件數量逐漸變多。

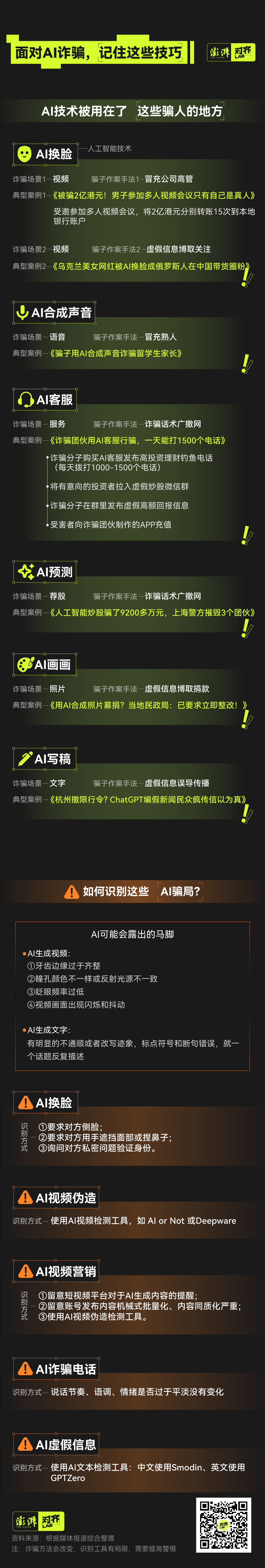

AI 實時換臉的方式是利用人臉識別模型和攝像頭來獲取人臉的關鍵特征點。這些特征點被用來在視頻中跟蹤人臉輪廓、眼睛、眉毛等區域的位置。

理論上,面部特征點越多,AI 換臉的效果越好。因而,為了打造一個逼真的 AI 換臉騙局,犯罪分子通常會廣泛搜集與被害人有關親友的視頻、照片等作為換臉素材。

北京朝陽法院指出,詐騙分子會利用 AI 技術對所要施行詐騙的人群進行篩選并生成定制化詐騙腳本。例如,在實施情感詐騙時,會篩選出經常發布情感信息的人;在實施金融詐騙時,會篩選出經常關注理財投資的人群。

在實際應用中,為了平衡網絡延遲、生成效果等多種因素,人臉特征的提取上只會保留最具有代表性的特征點。當這些最具有代表性的人臉特征點被遮擋或者數量減半時(側臉),AI 換臉就容易出現崩壞的情況。

論文 Joint Multi-view Face Alignment in the Wild 展現了人臉識別模型在不同人臉截面的特征點識別效果。從圖中可以看到,正臉特征點的識別效果遠比側臉要好。

這可以成為我們破解 AI 換臉的辦法之一。metaphysic.ai 的一項研究指出,在視頻通話等實時視頻場景中,AI 換臉效果會因為面部遮擋或側臉轉向而大打折扣。

測試者使用 AI 工具將自己的臉換成歐美明星。在用手遮擋面部后,AI 換臉出現了扭曲和面部波動的情況。在人臉側向攝像頭 90°時,AI 換臉在輪廓和人臉細節上出現了不同程度的崩壞和錯亂。圖片來源:metaphysic.ai

對于青睞“劃算又高效”、采取“廣撒網”策略的犯罪分子而言,進一步通過優化算法模型、增加更多訓練圖像等方式優化 AI 換臉效果的考慮較少。因而,當我們遇到存疑的視頻通話時,可以要求對方做一些面部運動,例如側臉轉向、進行面部遮擋、捏鼻子等,來辨識 AI 換臉的可能性。

除了 AI 換臉視頻通話,AI 換臉視頻還被很多營銷號用來導流、帶貨。為了抓住流量密碼,許多營銷號不惜侵犯個人肖像權。

目前,一些社交平臺已經對這類 AI 換臉賬號采取了封禁,但在短視頻平臺依舊能刷到類似的 AI 生成內容。圖片來源:新浪熱點

最近一兩個月,許多人都能在短視頻平臺頻繁刷到這位俄羅斯博主的視頻。這些短視頻有著統一的故事腳本,包括熱愛中國文化,想嫁給中國男人等,并希望看視頻的人能夠買一點俄羅斯特產。這些在全網傳播的短視頻,均是由營銷號通過 AI 換臉制作而成。人臉盜用自烏克蘭網紅奧爾嘉(Olga Loiek)。

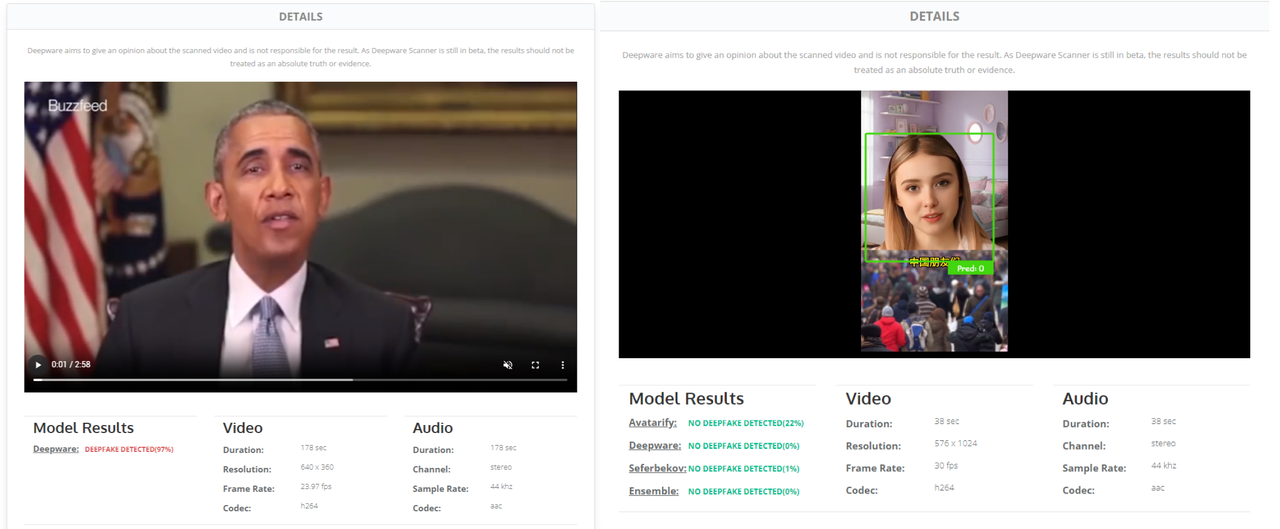

如何鑒別真假難辨的 AI 換臉短視頻?我們可以借助 Deepware 這類 AI 視頻識別工具。這類工具會在上傳視頻后,對視頻中存在 AI 生成或換臉內容進行分析,并給出識別報告。上圖左側是對早期 AI 換臉視頻的識別結果,右側是對近期俄羅斯 AI 網紅的識別結果。在 AI 換臉技術不斷迭代的今天,識別 AI 換臉的技術也急需更新換代。

除了使用 AI 視頻鑒定工具外,還可以留意短視頻平臺對于 AI 內容的標記提醒。記者檢索了包括抖音、小紅書、B 站等視頻平臺,許多 AI 生成的真人換臉短視頻下方都含有提示信息。以抖音為例,在用戶刷到 AI 生成內容的短視頻時,會標注“疑似包含 AI 創作信息,請注意甄別真實度”的提醒。這也為我們識別 AI 生成視頻提供了一定的參考。

AI 合成語音:鑒別不易,防范更難

與 AI 換臉視頻相比,AI 合成語音在詐騙中其實更難辨別。

全球安全技術公司邁克菲(McAfee)在 2023 年發布的調查報告中指出,只需提供3-4秒的錄音,網絡上的免費AI工具就能生成相似度達到85%的克隆人聲。在參與調查的 7000 多位全球受訪者中,有 70%的人不確定是否能分辨 AI 合成語音,而大約有 10%的人遭遇過 AI 語音詐騙。

在社交媒體上,許多留學生發帖表示曾遇到利用 AI 合成本人語音,對在國內的父母進行的詐騙。這些詐騙以綁架為名,放出 AI 合成的求救語音,同時利用時空差,在造成恐慌的心理下騙取大量金額。

以目前的 AI 技術,克隆一個人的聲音有多容易?我們以騷擾電話提取人聲為場景,進行了一段模擬:

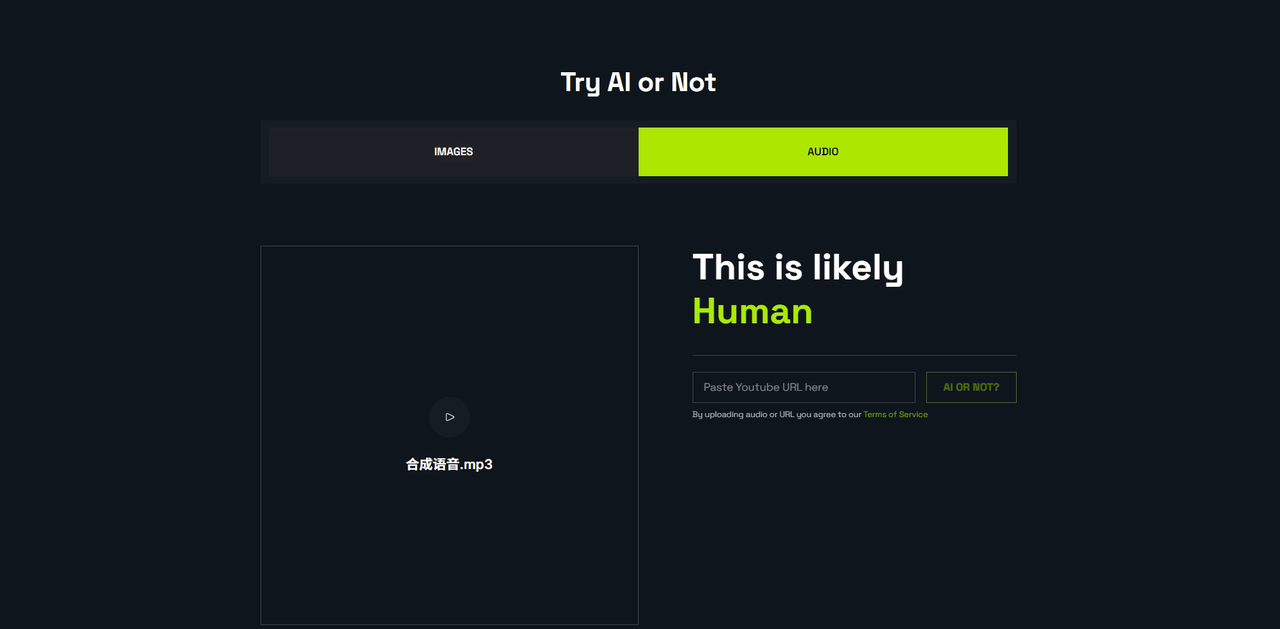

AI 工具對語音的檢測,一般關注合成語音中的頻率缺失部分、音調的起伏等。此外,檢測的準確性還受語音時長的影響。因此,在驗證對 AI 語音的懷疑上,AI 工具的結果還需結合我們對語音內容的辨析。AI 領域科學家 Dr. Adrian Kaehler 在接受一項采訪時也提出,“你可以引導其說出一些特定的話,從而幫你判斷真偽”,進行內容上的辨析。

回溯 AI 語音的騙局的生成,語音的泄露問題也值得加強關注。該騙局通常是通過騷擾電話錄音來獲取真實聲源。所以,面對未知來電時,我們可以在了解對方的信息之后再開口,減少不必要的信息泄露。

AI 虛假信息:識別效果參差不齊,中文支持差

與視頻、語音近來出現的“高端騙術”相比,用 AI 生成的虛假信息進行傳播算是“常規局”,但可能造成更廣泛的影響。在眾多的信息流之中,AI 生成的內容時常以假亂真,在信息層面上造成誤導甚至誘導。

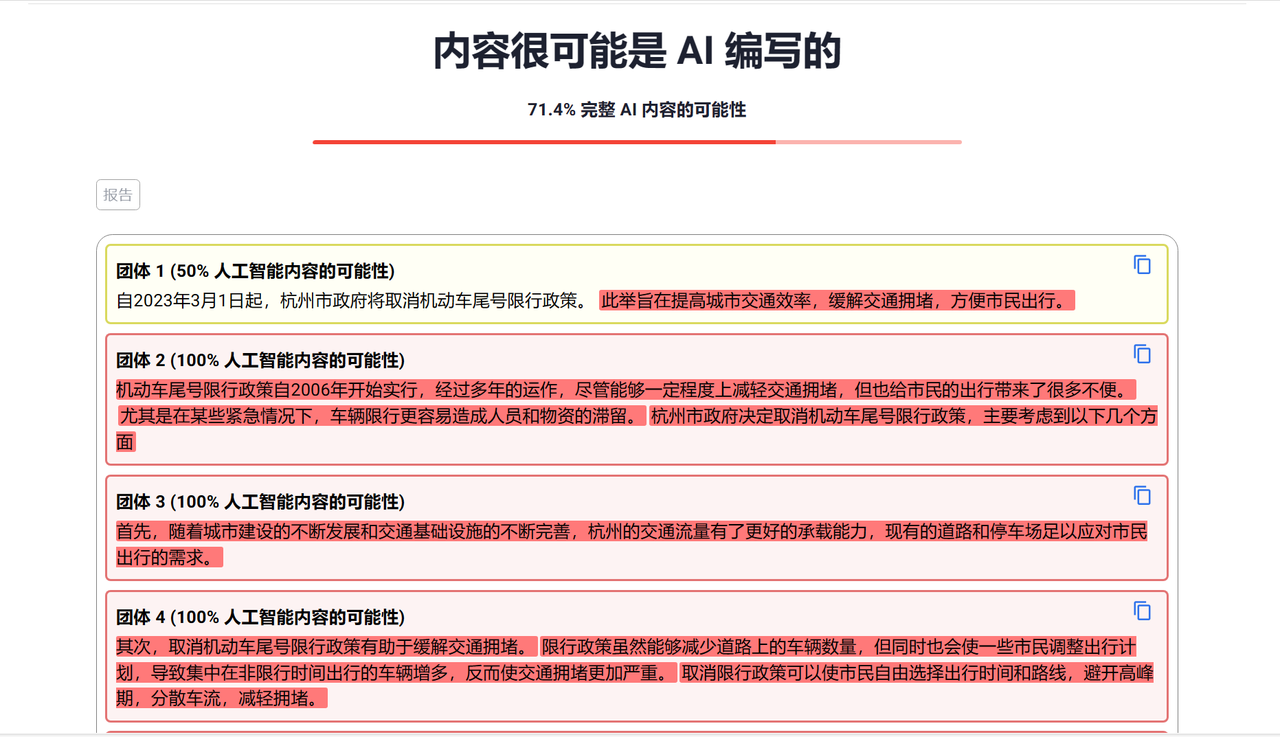

2023 年 2 月,一則有關“杭州市政府 3 月 1 號取消機動車依尾號限行”的“新聞稿”在網上瘋傳。隨后杭州警方證實,該消息不實。其內容來自于某小區業主群對 ChatGPT 的討論,不明實情的群友轉發了其中由 AI 寫作而成的新聞稿,造成錯誤信息的傳播,誤導公眾。

目前,市面上有諸多 AI 文本檢測工具為辨別 AI 生成內容提供服務,如 GPTZero、Copyleaks、Smodin 等。在實現 AI 檢測的原理上,GPTZero 主要關注困惑度(perplexity)和突發性(burstiness)這兩個指標,前者衡量文本的不可預測性,后者衡量句子結構和長度的變化。由于 AI 生成文本和人類生成文本的差異,檢測得以實現。

當我們將文本貼入這些工具的檢測框后,它們可以快速判斷出文本由 AI 生成的可能性,并高亮其判定為由 AI 生成的語句。

GPTZero界面

在實際操作中,我們發現 AI 檢測的準確度受長度的影響,GPTZero 對檢測文本的字符數就要求達 250。以及不同工具對不同語言文本的識別能力也有所分異。當我們選取上述以 GPT 寫作而成的假新聞稿作為檢測文本時,GPTZero 將其判定為完全由人寫成,而 Smodin 則給出了 71.4%的 AI 生成可能性,結果大相徑庭。

使用GPTZero的檢測結果

使用Smodin的檢測結果

在中文內容的檢測上,我們發現實際可用的工具較少。那么在遇到可疑信息時,還是少不了慣常的核查思路,追溯信息源、交叉求證……

不難發現,利用 AI 工具進行反詐騙的檢測,主要依據是人類與 AI 生成內容的不同點檢測。也正是因為這一點,AI 檢測工具無法穩定地保持較高的準確率。

面對日益猖獗的 AI 詐騙,我們能做的或許首先是引起重視并拓寬認知邊界,運用邏輯的思辨輔之以 AI 工具進行雙重保障與防范。

*封面圖由 Midjourney 生成

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2024 上海東方報業有限公司