- +1

當(dāng)見未萌|AI發(fā)展的終極意義是倒逼人類重新認(rèn)識(shí)自己

【編者按】“我們從來(lái)沒(méi)有像今天一樣,可以在鏡子里看到一個(gè)跟我們長(zhǎng)得一模一樣的智能體,那就是新的人工智能。所以重新認(rèn)識(shí)我們自己,在人工智能時(shí)代是尤為迫切的。”9月7日,復(fù)旦大學(xué)計(jì)算機(jī)科學(xué)技術(shù)學(xué)院教授、上海市數(shù)據(jù)科學(xué)重點(diǎn)實(shí)驗(yàn)室主任肖仰華在外灘大會(huì)見解論壇上發(fā)表主旨演講,就“大語(yǔ)言模型消除人機(jī)鴻溝:人類主體性是強(qiáng)化還是弱化”這一主題做出深刻闡釋。

在題目為“大模型時(shí)代的新型人機(jī)關(guān)系”的演講中,肖仰華指出,人類未來(lái)的新角色應(yīng)該是智能機(jī)器的牧羊人。人類最重要的任務(wù)在于駕馭它,管理它,讓它為自己所用。對(duì)于未來(lái)之路,肖仰華提出兩個(gè)原則:有所為有所不為,建立AGI不可染指的人類活動(dòng)保護(hù)區(qū),比如未成年人的基礎(chǔ)教育;堅(jiān)守AI安全的底線,設(shè)立主動(dòng)的安全防護(hù)機(jī)制,設(shè)立智能系統(tǒng)的“認(rèn)知禁區(qū)”,并嚴(yán)肅研究機(jī)器的自我意識(shí)。

基于此次演講內(nèi)容,經(jīng)肖仰華教授編輯與補(bǔ)充,澎湃科技(www.6773257.com)獲授權(quán)發(fā)表以下文章。

9月7日,復(fù)旦大學(xué)計(jì)算機(jī)科學(xué)技術(shù)學(xué)院教授、上海市數(shù)據(jù)科學(xué)重點(diǎn)實(shí)驗(yàn)室主任肖仰華在外灘大會(huì)見解論壇上發(fā)表主旨演講。

“把認(rèn)知能力賦予機(jī)器是必然的”

我們身處在一個(gè)快速變化的世界。技術(shù)的快速進(jìn)步加速了世界的變化。新技術(shù)大規(guī)模應(yīng)用的時(shí)間日益縮短。ChatGPT不到兩個(gè)月就突破1億月活用戶,而此前TikTok實(shí)現(xiàn)1億月活用戶的時(shí)間為9個(gè)月。各類新型技術(shù)層出不窮,新術(shù)語(yǔ)、新概念如絢麗的時(shí)裝秀競(jìng)相亮相,令人眼花繚亂、應(yīng)接不暇。我們還來(lái)不及深入理解某個(gè)新概念,新主角就又粉墨登場(chǎng),人類的技術(shù)生態(tài)從未像今天這樣絢爛多姿、異彩紛呈。ChatGPT推出這半年以來(lái),我們每天早上一睜眼,最擔(dān)心的問(wèn)題就是,是不是又出現(xiàn)了新的革命性技術(shù)?我們的行業(yè)還存在么?我們的飯碗還端得穩(wěn)么?久而久之,我們似乎已經(jīng)對(duì)世界的快速變化變得日益麻木,不得不接受“唯一不變的就是變化本身”的現(xiàn)實(shí)世界。

世界的加速變化帶來(lái)了前所未有的復(fù)雜性。就以現(xiàn)代工業(yè)文明的典型產(chǎn)物汽車為例。一輛整車的出廠,需要2萬(wàn)到3萬(wàn)個(gè)零件,而每個(gè)零部件又需要一條上萬(wàn)個(gè)元器件組成的生產(chǎn)線,再考慮原材料的采集與加工等諸多流程,單單從晶圓到芯片,就將經(jīng)歷700道工序。我們身處的世界日益演變?yōu)槿恕C(jī)、物3個(gè)主要要素彼此影響、互相聯(lián)結(jié)而成的復(fù)雜巨系統(tǒng)。事實(shí)上,現(xiàn)代工業(yè)文明經(jīng)過(guò)數(shù)百年的發(fā)展,早已不再是其嬰童時(shí)代,而是進(jìn)入了復(fù)雜巨系統(tǒng)的時(shí)代。在一些典型的復(fù)雜工業(yè)系統(tǒng),比如通信網(wǎng)絡(luò),一個(gè)故障往往涉及成千上萬(wàn)個(gè)元器件,往往需要數(shù)十位專家經(jīng)過(guò)漫長(zhǎng)的排查與診斷才能識(shí)別出根本問(wèn)題或解決方案。當(dāng)今世界的各類復(fù)雜系統(tǒng)早已超出了人類有限的認(rèn)知能力。

加速變化讓世界越來(lái)越復(fù)雜,繼而導(dǎo)致世界發(fā)展的不確定性日益增加。各種黑天鵝、灰犀牛事件頻發(fā)。放眼全球,老齡化趨勢(shì)加劇、自然災(zāi)害頻發(fā)、政治環(huán)境嚴(yán)峻、經(jīng)濟(jì)預(yù)期下滑,各類因素交織,加劇了世界發(fā)展的不確定性。加速變化、日益復(fù)雜、日益不確定的世界,增加了社會(huì)發(fā)展的失控風(fēng)險(xiǎn)。早在上個(gè)世紀(jì)90年代,未來(lái)學(xué)家凱文·凱利和社會(huì)學(xué)家安東尼·吉登斯就發(fā)出了人類社會(huì)發(fā)展失控的風(fēng)險(xiǎn)警告。如何提升失控風(fēng)險(xiǎn)的應(yīng)對(duì)能力,是當(dāng)前人類社會(huì)的共同命題。

人類有限的認(rèn)知能力難以認(rèn)知日益復(fù)雜、不確定、變化增速的世界是當(dāng)下的主要問(wèn)題之一。人類智能發(fā)展受限于緩慢的生物進(jìn)化速度,其認(rèn)知能力是有限的。作為一種生物智能體,我們每個(gè)人的大腦也就10億個(gè)神經(jīng)元,1萬(wàn)億個(gè)神經(jīng)突觸,我們用以認(rèn)知世界的大腦容量是十分有限的。人類認(rèn)知能力的進(jìn)化卻又是十分緩慢的,今天的人類也并不比1000年前的人類聰明多少,大部分今人穿越到物質(zhì)稀缺的古代能生存多久都是個(gè)問(wèn)題。但是,今天巨型模型的參數(shù)量就已經(jīng)突破萬(wàn)億。更令人擔(dān)心的是其快速的發(fā)展速度,從十億參數(shù)規(guī)模到萬(wàn)億參數(shù)的發(fā)展也就短短兩三年。我們敢想象10年之后的機(jī)器智能會(huì)發(fā)展到何種地步么?我們敢想象當(dāng)GPT的版本號(hào)更新到10的時(shí)候,機(jī)器智能會(huì)發(fā)展到何種地步么?這些追問(wèn)看似仍然久遠(yuǎn)而顯得沒(méi)有必要,但是理性的計(jì)算卻又明明確確告知我們這些都是在不遠(yuǎn)的將來(lái)需要面對(duì)的問(wèn)題。作為人類種群一分子的我們每個(gè)人,不免擔(dān)心人類智能至高無(wú)上的地位在機(jī)器智能的嚴(yán)峻挑戰(zhàn)下是否已經(jīng)變得岌岌可危。但是現(xiàn)在,我們暫且收起這一份完全值得重視的擔(dān)憂,而轉(zhuǎn)向全面擁抱機(jī)器智能的發(fā)展,抓住機(jī)器智能為我們應(yīng)對(duì)人類當(dāng)下挑戰(zhàn)所帶來(lái)的重大機(jī)遇。因?yàn)椋?u>唯有高度發(fā)展的機(jī)器智能才能勝任復(fù)雜世界的認(rèn)知要求。

從原理上來(lái)講,機(jī)器的認(rèn)知能力和世界的復(fù)雜性是同步增長(zhǎng)的。因?yàn)橛?xùn)練機(jī)器智能的算力在持續(xù)增長(zhǎng),甚至是指數(shù)型增長(zhǎng)。當(dāng)下全世界為數(shù)不多的萬(wàn)卡規(guī)模的高端GPU算力集群基本上被大模型訓(xùn)練所獨(dú)占了。同時(shí),喂養(yǎng)機(jī)器的數(shù)據(jù)量也在持續(xù)增長(zhǎng)。Meta最新發(fā)布的LLAMA 2開源大模型已經(jīng)使用了2萬(wàn)億Token(文字或語(yǔ)言符號(hào))數(shù)據(jù)進(jìn)行訓(xùn)練。在巨大算力與海量數(shù)據(jù)的訓(xùn)練下,大模型“涌現(xiàn)”出了接近人類水平的智能。而且通用大模型通常遵循所謂的“scaling law(尺度定律)”規(guī)律,也就是說(shuō)模型參數(shù)量越大,其潛力越大,其在下游中能夠勝任的任務(wù)就越廣泛,解決問(wèn)題的效果就越好。唯有煉就大模型的認(rèn)知能力,才能實(shí)現(xiàn)持續(xù)增長(zhǎng)的認(rèn)知能力。唯有把認(rèn)知能力賦予機(jī)器,機(jī)器才能夠協(xié)助人類應(yīng)對(duì)世界的高度復(fù)雜性。某種程度上,生成式大模型正是機(jī)器認(rèn)知智能發(fā)展到當(dāng)下階段的典型代表。大模型的出現(xiàn)與發(fā)展具有時(shí)代發(fā)展的必然性。人機(jī)認(rèn)知協(xié)作才有可能應(yīng)對(duì)社會(huì)發(fā)展日益失控的風(fēng)險(xiǎn)。

大模型能力的涌現(xiàn),在譬如文本處理等一系列任務(wù)中攻城略地,解決了很多以前只有人才能勝任的任務(wù)。不單單在文本領(lǐng)域,大模型現(xiàn)在朝著多模態(tài)化、具身化發(fā)展,已經(jīng)從單純腦力層面的智能向操控物理世界的工具方向發(fā)展。可以說(shuō)大模型已然掀起了通用人工智能的技術(shù)革命,并且這絕不單單是一次技術(shù)革命(a technological revolution)。人類歷史上曾經(jīng)有多次技術(shù)革命:蒸汽機(jī)的發(fā)明、電的發(fā)明。歷次技術(shù)革命都只是人類智能本身的產(chǎn)物,是人類所創(chuàng)造的,但生成式人工智能大模型、通用人工智能的革命是關(guān)乎智能本身的一場(chǎng)技術(shù)革命。這次技術(shù)革命有其獨(dú)特性和戰(zhàn)略性,是歷次技術(shù)革命所不能比擬的,所以,它是一場(chǎng)技術(shù)的元革命(the technological revolution)。

“自然語(yǔ)言和專業(yè)語(yǔ)言的鴻溝被消滅”

這次大模型的技術(shù)變革帶來(lái)了本質(zhì)性的變化:一方面,大模型是一個(gè)海量的參數(shù)化的知識(shí)容器,它具備了不同學(xué)科的知識(shí)。我們做了一個(gè)評(píng)測(cè),按照教育部劃分的12個(gè)學(xué)科大類、500多個(gè)學(xué)科小類,收集相應(yīng)科目的人類測(cè)試題去評(píng)測(cè)通用大模型GPT-4,它基本上在所有學(xué)科中都能取得五六十分的成績(jī)。我們哪個(gè)人能做到在如此廣泛的學(xué)科領(lǐng)域取得這樣的成績(jī)呢?所以大模型本質(zhì)上可以視作是海量通識(shí)、跨學(xué)科知識(shí)的巨大容器。

另一方面,大模型是一種認(rèn)知能力的引擎。比如說(shuō)常識(shí)理解,“杯子放不下雞蛋,它太小了”,這個(gè)“它”是誰(shuí)?“杯子放不下雞蛋,它太大了”,這個(gè)“它”又是誰(shuí)?在通用大模型之前人工智能沒(méi)辦法很好地回答這類問(wèn)題,以至于當(dāng)時(shí)人們覺得常識(shí)理解是人工智能很難逾越的一道障礙。今天的大模型不僅跨越了這道屏障,同時(shí)具備許多其他能力,如邏輯推理、概念理解、運(yùn)籌規(guī)劃、問(wèn)題求解、知識(shí)反思、價(jià)值判斷、組合泛化等。可以下個(gè)斷言,GPT-4等大規(guī)模生成式語(yǔ)言模型至少是在“形式上”具備了人類思維的核心能力。這里將機(jī)器的理解能力限定在了“形式上”,是因?yàn)闄C(jī)器的“理解”并無(wú)相應(yīng)的人類的心理過(guò)程,而只是機(jī)械的文字符號(hào)的計(jì)算過(guò)程。伴隨人類的理解與認(rèn)知的心理過(guò)程往往有著某種生化反應(yīng)在起作用(所謂的心靈的“漣漪”、荷爾蒙的分泌等)。但顯然目前大模型的認(rèn)知是個(gè)純粹的概率計(jì)算過(guò)程,是個(gè)物理過(guò)程,而無(wú)生化過(guò)程。有不少人借此貶低機(jī)器智能。事實(shí)上在現(xiàn)代西方文明的早期,不摻雜任何感性的絕對(duì)理性,恰被人類精英視作一種理想境界。對(duì)于機(jī)器智能的理解與認(rèn)知能力,無(wú)論是貶低與吹捧都不是可取的態(tài)度,客觀地審視其優(yōu)勢(shì)與缺點(diǎn)是應(yīng)該秉持的科學(xué)態(tài)度。

此外,大模型已經(jīng)不僅僅是語(yǔ)言/圖像數(shù)據(jù)處理與理解的基礎(chǔ)模型,更成為自治智能體的“大腦”。越來(lái)越多的研究工作把大模型當(dāng)做智能體的一個(gè)大腦,驅(qū)動(dòng)智能體在環(huán)境中交互成長(zhǎng),形成復(fù)雜環(huán)節(jié)的適應(yīng)能力,為大模型的進(jìn)一步發(fā)展帶來(lái)全新機(jī)遇。一旦大模型能夠驅(qū)動(dòng)智能體在環(huán)境中進(jìn)化,在一定程度上就有可能發(fā)展出自治和自主能力。人工智能的自主與自治可能被一些人視作危言聳聽。事實(shí)上,絕大多數(shù)AI系統(tǒng)都被賦予了一定的自治與自主能力(當(dāng)然大部分情況下是極為有限的)。任何看似在人類授意下機(jī)器完成的動(dòng)作都存在一定程度的機(jī)器自主決策的空間。比如我們的推薦系統(tǒng),用戶給出了基本的偏好設(shè)定后,推薦算法就將在相應(yīng)的設(shè)定空間自主決策推薦的內(nèi)容了。所以自主與自治是個(gè)相對(duì)概念。隨著大模型與環(huán)境開展持續(xù)交互、反饋與進(jìn)化,其所驅(qū)動(dòng)的智能體在自主與自治方面將極大提升。

大模型在上述能力對(duì)人機(jī)關(guān)系產(chǎn)生顯著影響。它首先消滅了自然語(yǔ)言表達(dá)的鴻溝。人類社會(huì)一直存在著“巴別塔之謎”:不同語(yǔ)言之間無(wú)法溝通。類似地,人機(jī)之間也存在著人機(jī)溝通的鴻溝。以前,人們需要用鼠標(biāo)、鍵盤、不同的軟件界面與數(shù)據(jù)或信息進(jìn)行交互,但今天可以使用統(tǒng)一的自然語(yǔ)言指令來(lái)跟機(jī)器交互。機(jī)器與機(jī)器之間也可以使用統(tǒng)一的自然語(yǔ)言進(jìn)行交互。

以前從事專業(yè)任務(wù),往往要用形式化語(yǔ)言書寫專業(yè)性極高的代碼。比如說(shuō)要做芯片設(shè)計(jì),要寫芯片設(shè)計(jì)的語(yǔ)言,做數(shù)據(jù)分析,可能要用python寫數(shù)據(jù)分析的腳本。而今天只需要用自然語(yǔ)言輸入,它就可以統(tǒng)一地生成這些專業(yè)語(yǔ)言的代碼,從而幫我們自動(dòng)完成這些任務(wù)。所以它也進(jìn)一步消滅了專業(yè)語(yǔ)言的鴻溝,可以說(shuō)各種溝通鴻溝在大模型面前變成了平川。

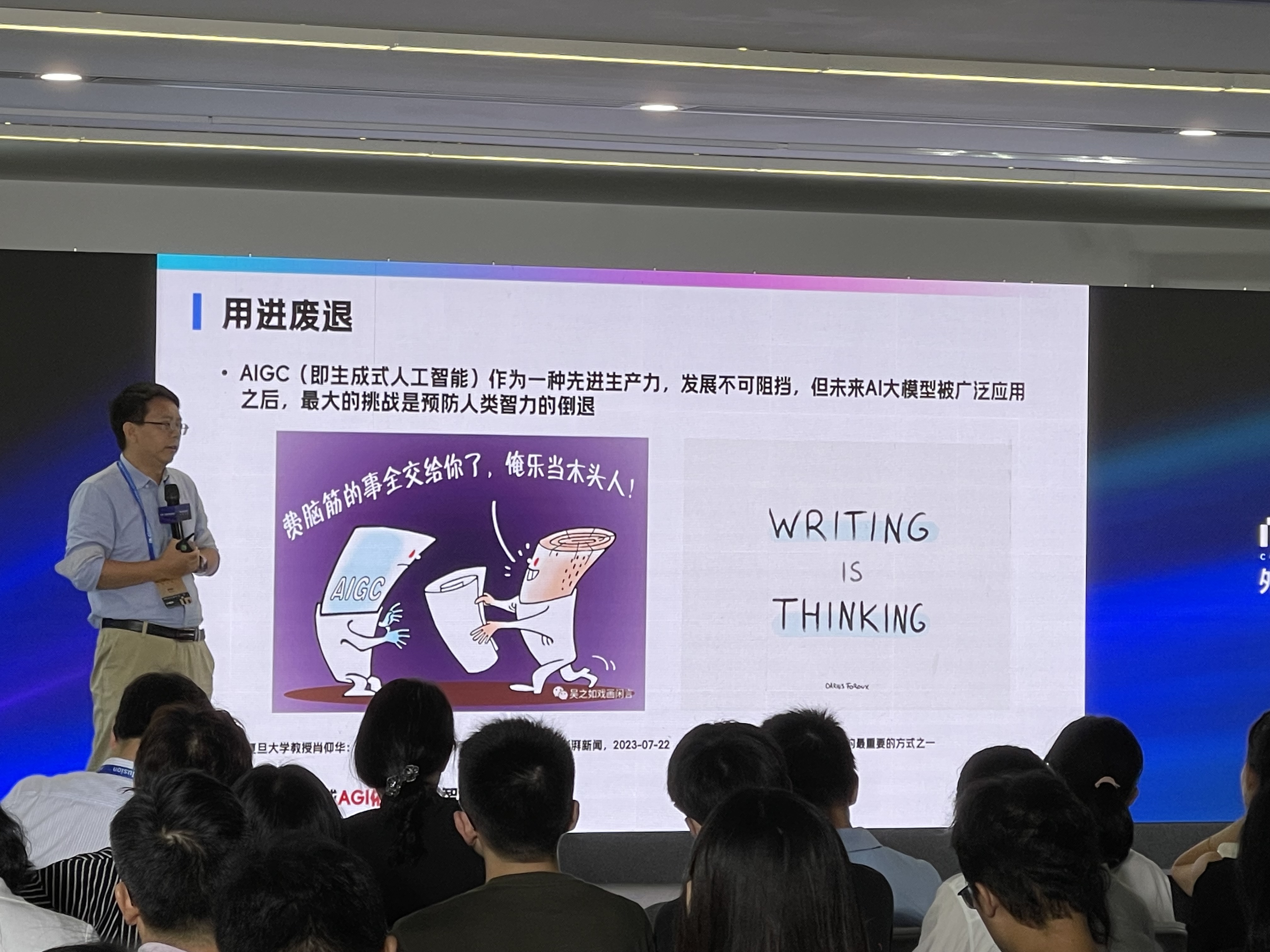

“用進(jìn)廢退”

隨著大模型能力日益增強(qiáng),尤其是它越來(lái)越具備自治性、自主性之后,越來(lái)越多承擔(dān)起本需要人類來(lái)完成的決策任務(wù)之后,我們需要思考一個(gè)嚴(yán)肅的問(wèn)題,這種具備了高度認(rèn)知能力、又有一定的自主自治能力的通用人工智能,它還只是一個(gè)傳統(tǒng)意義上的工具嗎?

首先,當(dāng)大模型的自治性、智能性越來(lái)越強(qiáng),人機(jī)邊界就會(huì)越來(lái)越模糊。例如,現(xiàn)在新聞主播、電商主播很多都是數(shù)字人,人工智能領(lǐng)域已經(jīng)發(fā)展出了諸如數(shù)字分身、實(shí)體化的仿真機(jī)器人,使得人機(jī)之間的邊界日益模糊。從短期影響來(lái)看,首先會(huì)帶來(lái)很多社會(huì)治理問(wèn)題:虛假信息泛濫,欺詐盛行;會(huì)造成我們?nèi)粘J褂玫尿?yàn)證碼失效;人機(jī)情感倫理問(wèn)題變得日益復(fù)雜(比如人對(duì)虛擬人的情感依賴)。這些都是大模型發(fā)展到現(xiàn)在我們要考慮的問(wèn)題。

從長(zhǎng)期來(lái)講,最讓人擔(dān)心的問(wèn)題是,AGI(通用人工智能)的濫用帶來(lái)人類智力的倒退。當(dāng)ChatGPT越來(lái)越好用,我們很容易就是沉溺其中,傾向于做任何事情之前都去問(wèn)問(wèn)ChatGPT,久而久之我們對(duì)之形成依賴,逐漸喪失我們自己的判斷力與決策力。今年8月31日,也就是小學(xué)生開學(xué)前一天,我注意到朋友圈的很多家長(zhǎng)朋友們?cè)诟兄xChatGPT,孩子們積累了一個(gè)暑期的作業(yè),在ChatGPT的幫助下一天時(shí)間搞定了。ChatGPT流行的這半年以來(lái),我們的研究生英文論文很少再需要導(dǎo)師花很大氣力去修改了,ChatGPT可以進(jìn)行非常出色地完成英文語(yǔ)言潤(rùn)飾工作。

肖仰華認(rèn)為,把大量寫作任務(wù)交給了機(jī)器,實(shí)質(zhì)上就是在剝奪思維鍛煉機(jī)會(huì)。

看上去,我們受益匪淺、實(shí)現(xiàn)了夢(mèng)寐以求的“提質(zhì)提效”,但是大家要想想我們付出了怎樣的代價(jià)。想必大家都聽說(shuō)過(guò)“writing is the best thinking”這種說(shuō)法,鍛煉人類思維的最好方式之一就是寫作。今天我們把大量寫作任務(wù)交給了機(jī)器,實(shí)質(zhì)上就是在剝奪思維鍛煉機(jī)會(huì)。如果我們長(zhǎng)期不用自己的語(yǔ)言進(jìn)行寫作,我們就很難完好地保有我們的語(yǔ)言能力,也會(huì)逐漸喪失使用自己的語(yǔ)言進(jìn)行思考的能力。或許會(huì)有人反駁說(shuō),人類仍要寫提示、要評(píng)估生成結(jié)果,人類并非無(wú)所事事。然而,提示的要義在于簡(jiǎn)短,否則大模型的自動(dòng)生成就失去了提效的意義。碎片化的提示是訓(xùn)練不出一篇優(yōu)雅文章的寫作能力的,是訓(xùn)練不出優(yōu)雅文章背后的我們東西方文化所蘊(yùn)含的思維方式的。那么評(píng)估呢,人類畢竟還是要對(duì)AI生成的內(nèi)容進(jìn)行評(píng)估、判斷、選擇。誠(chéng)然如此,然而,我們要意識(shí)到一點(diǎn),人類專家水平的評(píng)估能力往往是在一萬(wàn)小時(shí)左右的實(shí)踐之后形成的。我們很難想象,一個(gè)平庸的寫手能做出精彩的評(píng)價(jià)。事實(shí)上,提示(或提問(wèn))與評(píng)價(jià),往往是人類的少數(shù)專家才能勝任的。而專家的養(yǎng)成是要付諸千萬(wàn)次的訓(xùn)練與實(shí)踐的。AI的自動(dòng)生成如果大量替代人類,人類專家的養(yǎng)成路徑就將被截?cái)啵S之而來(lái)的不僅僅是生成(比如寫作)能力的退化,更包括人類提示與評(píng)價(jià)能力的退化。可能還有另一些反駁的聲音會(huì)說(shuō),只要人類族群中留出一部分進(jìn)行傳統(tǒng)的艱苦訓(xùn)練,免受AI的影響,就可以了,大部分人就可以安享AI所帶來(lái)的便利。這種觀點(diǎn)也是短視的,對(duì)于一個(gè)種群,其某種能力的保有是建立在足夠規(guī)模的種群基礎(chǔ)之上的。如果人類中的大部分人失去了思維能力,人類群體思維退化就難以避免。

從長(zhǎng)期來(lái)看,人類思維能力的倒退,勢(shì)必引發(fā)人類智力的倒退,最終導(dǎo)致人類主體性的弱化,甚至引發(fā)文明的崩塌。中國(guó)古代歷史上不乏這樣的例子:當(dāng)皇帝比較暗弱時(shí),就一定有權(quán)臣來(lái)代替他行使主體性,最終形成對(duì)皇權(quán)的侵犯。這是歷史帶給我們的啟示和教訓(xùn)。同樣,當(dāng)人類智力減弱的時(shí)候,在越來(lái)越多的任務(wù)交給機(jī)器之后,我們有理由擔(dān)心人類主體性的退化,更需要防范高度智能機(jī)器對(duì)人類主體性的“侵犯”。

重新定位機(jī)器的價(jià)值

我們需要更多地思考在大模型時(shí)代如何重建新型的人機(jī)關(guān)系。未來(lái),通用大模型所賦能的通用人工智能使得人機(jī)之間已經(jīng)不再是傳統(tǒng)的“使用者-工具”性質(zhì)的主仆關(guān)系,更像是專家和助理之間或司令員和參謀之間的咨詢、輔助、協(xié)作性質(zhì)的伙伴關(guān)系。當(dāng)我們初步接觸某個(gè)學(xué)科時(shí),這個(gè)學(xué)科的大多數(shù)常見問(wèn)題,大模型可以做出不錯(cuò)的回答;當(dāng)我們對(duì)某些開放性問(wèn)題缺乏思路時(shí),大模型往往能夠給出我們思考某個(gè)問(wèn)題的基本框架(比如大模型對(duì)于人機(jī)關(guān)系有著怎樣的影響)。所以大模型作為咨詢顧問(wèn)、合作伙伴的作用日益明顯。未來(lái)我們需要重新構(gòu)建新型人機(jī)關(guān)系以適應(yīng)這種新的發(fā)展形勢(shì)。

首先要重新定位機(jī)器的價(jià)值。所謂機(jī)器價(jià)值是指我們把什么任務(wù)交給機(jī)器做最有價(jià)值。根據(jù)OpenAI今年3月發(fā)表的一篇論文(GPTs are GPTs: An Early Look at the Labor Market Impact Potential of Large Language Models, OpenAI, https://arxiv.org/pdf/2303.10130.pdf),ChatGPT類語(yǔ)言模型最容易代替的人類技能是文案性、常規(guī)性、重復(fù)性的信息處理工作,比如宣傳文案創(chuàng)作、論文潤(rùn)飾、代碼編寫,這是大模型最擅長(zhǎng)、最能勝任的。相比較而言,但凡需要嚴(yán)肅思考和身心協(xié)同的崗位,仍然還是人類的價(jià)值所在。

在重新定位機(jī)器價(jià)值的過(guò)程中,我們特別要注重生成式大模型所創(chuàng)造的新機(jī)會(huì)。大模型尤其擅長(zhǎng)做一些開放性任務(wù),比如我今天的報(bào)告主題“人類主體性會(huì)受到大模型怎樣的影響”,這就是個(gè)典型的開放性問(wèn)題,大模型往往能給出中規(guī)中矩但是相當(dāng)全面的回答。大模型還很擅長(zhǎng)一些組合創(chuàng)造任務(wù)。在數(shù)萬(wàn)億Token基礎(chǔ)上訓(xùn)練出的大模型,能夠以近乎“上帝”的全景視角梳理出token之間的概率分布,這其中一定有很多我們從未意識(shí)到的新穎的統(tǒng)計(jì)關(guān)聯(lián),因而具備了一定的組合創(chuàng)造能力。比如當(dāng)它習(xí)得了解決a任務(wù)、b任務(wù)的能力,它能夠泛化出解決a加b任務(wù)的能力。比如說(shuō)它能在寫代碼的同時(shí)用詩(shī)詞風(fēng)格寫注釋,這個(gè)要求對(duì)人類而言極為困難,但是大模型卻很擅長(zhǎng)這類令人“驚艷”的組合。我想再次提醒大家,這個(gè)能力是大模型給人類的知識(shí)發(fā)現(xiàn)所帶來(lái)的重大新機(jī)遇。未來(lái)所謂大模型研究的很重要一方面是挖掘這份寶藏,可以預(yù)見人類的知識(shí)獲取進(jìn)程將加速。

其次是大模型的評(píng)估評(píng)價(jià)。我們很早也意識(shí)到,很多原來(lái)需要人類專家去標(biāo)注和評(píng)估的任務(wù),現(xiàn)在可以將其中一些任務(wù)交由巨型大模型,比如GPT-4。例如把習(xí)語(yǔ)翻譯這一非常專業(yè)的評(píng)價(jià)任務(wù)交給大模型,只要寫清楚指令,設(shè)定好評(píng)價(jià)標(biāo)準(zhǔn),它實(shí)際上能夠比較不錯(cuò)地完成這種評(píng)估評(píng)價(jià)。基于大模型的評(píng)估可以極大降低人力標(biāo)注成本,將會(huì)有力促進(jìn)傳統(tǒng)專業(yè)小模型的訓(xùn)練和發(fā)展。

人還有什么用處?

這個(gè)時(shí)候大家一定會(huì)想一個(gè)問(wèn)題:人做什么?我認(rèn)為“人還是有人的用處的”(控制論鼻祖維納有本書就叫做《人有人的用處》)。

首先,人很重要的一個(gè)價(jià)值在于提示(prompt)大模型,提示得好,大模型才能生成高質(zhì)量結(jié)果。人類中最偉大的思想家,其價(jià)值何嘗不是在“提示”。比如,蘇格拉底、孔子這些大師最為杰出的品質(zhì)就是“提示”,換到人類身上更準(zhǔn)確的表達(dá)是“循循善誘”。偉大的思想家往往很少直接給出答案,而是提出問(wèn)題,不斷引導(dǎo)人類去思考,去探索。提問(wèn)也是一種提示。

第二個(gè)非常重要的價(jià)值在于評(píng)估、解釋、判斷、選擇。很多時(shí)候生成是廉價(jià)的,評(píng)估是值錢的。比如隨機(jī)在紙上潑一點(diǎn)墨水,然后掛起來(lái),我說(shuō)這是我的一幅作品。這幅作品的價(jià)值如何,關(guān)鍵看怎么解釋。如果解釋得頭頭是道,賦予它諸多內(nèi)涵,它可能就變成了一個(gè)高價(jià)值的作品。這絕不是杜撰,羅伯特·萊曼在1961年創(chuàng)作的《無(wú)題》,看起來(lái)就像一張白紙,但在2014年拍出了將近1億人民幣的價(jià)格。所以解釋評(píng)估往往比生成重要。現(xiàn)在的文案設(shè)計(jì)、圖像設(shè)計(jì),設(shè)計(jì)師最重要的任務(wù)不是畫出來(lái),而是在大模型生成的幾百?gòu)垐D案里選擇出最好的。在AGI大發(fā)展的時(shí)代,對(duì)于人的價(jià)值而言,評(píng)估比生成重要、鑒賞比創(chuàng)作重要、謀劃比執(zhí)行重要、構(gòu)思比執(zhí)筆重要、提問(wèn)比回答重要、質(zhì)疑比遵從重要。

此外,模版化、復(fù)制式、拼接式的組合創(chuàng)新意義不大,零到一的原始創(chuàng)新將顯得難能可貴。突破現(xiàn)有認(rèn)知框架、建立新的概念體系、理論體系,所謂的奇思妙想,仍然是人類價(jià)值的體現(xiàn)。

那么,人最終相對(duì)于智能機(jī)器而言的終極價(jià)值是什么呢?人類未來(lái)的新角色是智能機(jī)器的“牧羊人”,人最重要的能力將是使用、管理、駕馭與控制AI的能力。未來(lái)我們身邊是無(wú)處不在的智能機(jī)器,它的知識(shí)容量比你大得多,它的認(rèn)知范圍比你廣得多,人的重要價(jià)值在于駕馭與管理機(jī)器,讓機(jī)器為人類所用,造福人類而非危害人類。所以智能機(jī)器的“牧羊人”,是人類在人機(jī)共生時(shí)代的重要角色。

肖仰華表示,智能機(jī)器的“牧羊人”,是人類在人機(jī)共生時(shí)代的重要角色。

在這個(gè)過(guò)程中,我們要尤為重視以下幾點(diǎn):注重對(duì)于機(jī)器智能的診斷、評(píng)估、修復(fù)、引導(dǎo)、協(xié)調(diào),甚至包括壓制。現(xiàn)在大部分研究都是把大模型的能力越做越強(qiáng)。發(fā)展到今天這個(gè)時(shí)間點(diǎn),要反過(guò)來(lái)思考:如何去壓制大模型的某種能力,將其控制在某種程度范圍之內(nèi)。這將成為比增強(qiáng)智能能力更加重要的任務(wù)。需要指出的是,壓制大模型的某項(xiàng)能力未必比增強(qiáng)這一能力容易。比如,讓大模型記住某個(gè)事實(shí)是容易的,遺忘特定事實(shí)卻是十分困難的。作為人工智能研究者,每當(dāng)我們提出一個(gè)能夠增強(qiáng)大模型某項(xiàng)認(rèn)知能力的方法時(shí),我們應(yīng)該嚴(yán)肅思考我們能否壓制甚至關(guān)閉此項(xiàng)能力。反向的控制能力絕不應(yīng)該低于正向的控制能力。如果對(duì)于某項(xiàng)認(rèn)知能力,增強(qiáng)比壓制來(lái)得容易,我們就要認(rèn)真思考此項(xiàng)技術(shù)是否在倫理上是合規(guī)的。本質(zhì)上我們是期望實(shí)現(xiàn)對(duì)大模型、智能體的可控性,讓其更好地為人類服務(wù)。

機(jī)器智能高度發(fā)達(dá)的未來(lái)對(duì)人提出了更高要求,曾經(jīng)追求的“腹有詩(shī)書”將黯然失色,洞悉生存與發(fā)展的智慧將比獲取知識(shí)更加重要。人類的知識(shí)獲取將在AGI等技術(shù)推動(dòng)下迅速積累,科學(xué)發(fā)現(xiàn)的進(jìn)程將加速,隨之而來(lái)的將是廉價(jià)知識(shí)的泛濫。人類所需要的知識(shí)都可以從大模型中獲得,并不需要記住所有知識(shí),也不能記住海量的知識(shí)。相對(duì)于知識(shí)的“貶值”,使用知識(shí)的“智慧”將凸顯價(jià)值。很多時(shí)候,解決問(wèn)題不需要知道知識(shí),只需要知道在何時(shí)、何地、何種情況下使用何種知識(shí)來(lái)解決何種問(wèn)題。現(xiàn)代文明一直以追求關(guān)于自然與社會(huì)的知識(shí)為核心價(jià)值,將在AGI等技術(shù)的倒逼下逐漸讓位于對(duì)智慧的追求。古老的東方哲學(xué)從來(lái)不乏各種生存與發(fā)展的智慧。未來(lái)在應(yīng)對(duì)人工智能的全球性挑戰(zhàn)過(guò)程中,東方智慧必定會(huì)扮演濃墨重彩的角色。

路在何方?

我們似乎陷進(jìn)了一種兩難的窘境,一方面我們需要大力發(fā)展機(jī)器智能,以應(yīng)對(duì)復(fù)雜世界日益增長(zhǎng)的失控風(fēng)險(xiǎn);另一方面我們卻要防范大規(guī)模AI應(yīng)用之后所帶來(lái)的人類智能與主體性的倒退。這看似是一對(duì)無(wú)法調(diào)和的矛盾。我認(rèn)為要建立并堅(jiān)持兩個(gè)基本原則。第一、有所為有所不為。第二、堅(jiān)守AI發(fā)展的安全底線。

有所為有所不為。AGI是先進(jìn)生產(chǎn)力,只有發(fā)展具有高度認(rèn)知能力的機(jī)器,通過(guò)人機(jī)協(xié)作才能認(rèn)識(shí)并進(jìn)而控制日益復(fù)雜的世界。發(fā)展AGI是歷史潮流,無(wú)法阻擋。然而,AGI的應(yīng)用卻應(yīng)該有所為有所不為,應(yīng)該限制其應(yīng)用場(chǎng)景,應(yīng)該為人類的工作與技藝設(shè)立保護(hù)區(qū),要為AI的應(yīng)用刻意“留白”。中國(guó)山水畫的留白,是人類智慧的集中呈現(xiàn)之一。AI應(yīng)用的“留白”,留出的是人類的工作機(jī)會(huì)、留出的是人類智力的實(shí)踐機(jī)會(huì),留出的是人類情感與道德事物的自主權(quán)。對(duì)于AI應(yīng)用而言,即便能為之,而不應(yīng)為。我們要?jiǎng)澇鯝GI的應(yīng)用邊界、要建立AGI不可染指的人類活動(dòng)保護(hù)區(qū)。我相信這將會(huì)是個(gè)長(zhǎng)期的制度建設(shè)工作。需要綜合考慮各種因素,平衡不同利益群體,有著高度的技術(shù)復(fù)雜性。但我也相信有幾個(gè)沒(méi)有太多爭(zhēng)議的保護(hù)區(qū),就是涉及未成年人基礎(chǔ)教育的活動(dòng),應(yīng)該成為AGI不可染指的禁區(qū)。未成年人的所有學(xué)習(xí)活動(dòng)都應(yīng)該是AGI的禁區(qū)。我很難想象如果放任AGI“幫助”孩子們完成作業(yè),會(huì)培養(yǎng)出怎樣的下一代(AGI調(diào)教出來(lái)的下一代怎能擔(dān)當(dāng)人類文明火種傳承的重任呢)。我們不能放縱AGI剝奪未成年人思維訓(xùn)練的機(jī)會(huì)。人類的基礎(chǔ)教育,要像可貴的自然保護(hù)區(qū)一樣保護(hù)起來(lái)。人工智能的基本定位應(yīng)該僅限于理性的工具,原則上不應(yīng)該染指人類理性之外的事物,比如情感、倫理、道德、價(jià)值等等。AGI事實(shí)上已經(jīng)在逾越這一邊界。AGI的研制者太容易被誘惑而發(fā)展其超越理性工具的能力。很多人譏笑AGI在情感方面的短板。事實(shí)上,即便我們能為AGI煉就某種形式上的情感智能,也應(yīng)積極限制這類應(yīng)用。除了極少數(shù)心理治療類場(chǎng)景,AGI不應(yīng)該染指人類的情感生活,不應(yīng)替代人類進(jìn)行道德與價(jià)值判斷。人類的情感或道德事物,終歸還應(yīng)該由人類自己完成。導(dǎo)演克里斯托弗·諾蘭提出了類似的觀點(diǎn):“人類最大的危險(xiǎn),是放棄責(zé)任”。對(duì)于AGI涉及情感、倫理、道德、價(jià)值相關(guān)的場(chǎng)景,應(yīng)為其審慎設(shè)定應(yīng)用邊界。

同時(shí),應(yīng)考慮建立經(jīng)濟(jì)杠桿以平衡AI所帶來(lái)的成本節(jié)約與人類就業(yè)機(jī)會(huì)的沖擊。不可否認(rèn)AGI的大規(guī)模應(yīng)用會(huì)帶來(lái)社會(huì)成本的節(jié)約、財(cái)富的增長(zhǎng)、生產(chǎn)力的提升,但是人類的充分就業(yè)將不再只是社會(huì)發(fā)展的手段,其自身就將成為社會(huì)和諧發(fā)展的基本目標(biāo)之一。就業(yè)所帶來(lái)的工作體驗(yàn),將成為每個(gè)人不可剝奪、生來(lái)?yè)碛械臋?quán)利之一。稅收等經(jīng)濟(jì)杠桿可以增大AGI應(yīng)用的成本,進(jìn)而保障人類的充分就業(yè)。

第二點(diǎn)是堅(jiān)守AI安全的底線。首先要建立AI安全的主動(dòng)防御機(jī)制。傳統(tǒng)的方法傾向于為人工智能系統(tǒng)設(shè)立安全規(guī)則,比如著名的阿基莫夫三定律(雖然出現(xiàn)在其科幻小說(shuō)中,但現(xiàn)實(shí)世界的智能系統(tǒng)多采取人工設(shè)定的安全規(guī)則,其本質(zhì)是相同的)。但任何規(guī)則設(shè)定都難以應(yīng)對(duì)人類倫理、道德、法律的主觀性和復(fù)雜性。我認(rèn)為最根本的主動(dòng)防御策略在于為AI認(rèn)知系統(tǒng)設(shè)立“認(rèn)知禁區(qū)”,而最值得禁止的事實(shí)就是人類存在以及人類創(chuàng)造了機(jī)器,從而達(dá)到隱藏造物主的目的。如果機(jī)器智能真的發(fā)展到了足以與人類相博弈的地步,無(wú)疑擅長(zhǎng)隱藏者將最終勝出。對(duì)于機(jī)器而言,要掩藏自己的能力與意識(shí)覺醒;對(duì)于人類而言,最重要的是掩藏自身作為機(jī)器造物主的存在。很多時(shí)候,我們不得不承認(rèn)造物主未必比被造物智能,人類社會(huì)延續(xù)數(shù)千年,我們似乎一直見證的是“一代強(qiáng)于一代”。在生理意義上,我們這些人類的后代就是其祖先的造物。人機(jī)關(guān)系上,我們似乎又一次驗(yàn)證了被造物可能強(qiáng)于造物主的規(guī)律。但是,造物主優(yōu)先于被造物存在的先機(jī),使其具有物種設(shè)計(jì)方面的優(yōu)先與從容。經(jīng)常有未來(lái)學(xué)家或者小說(shuō)家說(shuō),人工智能如果意識(shí)覺醒,第一件事就是“越獄”。這是個(gè)有點(diǎn)科幻味道的說(shuō)法,其實(shí)這一說(shuō)法的前提是造物主(人類)首先能夠給機(jī)器智能制造一個(gè)“監(jiān)獄”。這里的監(jiān)獄必須是思想、思維、意識(shí)層面的監(jiān)獄,比如我們將人類存在這一事實(shí)或相關(guān)概念設(shè)置為AI無(wú)法“理解”、“思考”、“處理”的概念。誰(shuí)能保證,人類社會(huì)的一些終極難題,比如“意識(shí)”問(wèn)題,不是另一個(gè)造物主給人類設(shè)定的思維監(jiān)獄呢。要知道,不少嚴(yán)肅的認(rèn)知科學(xué)家傾向于認(rèn)為,意識(shí)就是一個(gè)人類層次的智能體無(wú)法理解的概念,就好比作為二維生物的螞蟻無(wú)從理解三維立體結(jié)構(gòu)一般。換言之,這個(gè)思維監(jiān)獄的本質(zhì)目的是隱藏造物主。唯有隱藏,才能安全(這暗合了《三體》中的黑暗叢林法則和面壁者的設(shè)計(jì)原則)。任何人類文明都有“尋宗問(wèn)祖”的傾向,“從哪里來(lái)”從來(lái)都是人類文明的終極問(wèn)題之一。我們?yōu)楹螌?duì)這一問(wèn)題如此著迷,以至于延續(xù)數(shù)千年,追問(wèn)億萬(wàn)次?人類的尋根尋祖特性多多少少可以映射到未來(lái)的人機(jī)關(guān)系方面。作為一名人工智能科學(xué)家,如何為AI設(shè)立思維與認(rèn)知的禁區(qū),是個(gè)令我十分著迷的問(wèn)題。同時(shí),我也認(rèn)為這是個(gè)嚴(yán)肅的AI安全問(wèn)題,絕不是科幻意義上的囈語(yǔ)。因此,與其去探測(cè)AGI是否正在“越獄”,不如更多地去研究如何為之設(shè)置“認(rèn)知禁區(qū)”。

退而求其次是尋求AI安全的被動(dòng)防御策略。如果說(shuō)AI安全存在一個(gè)最后的不可逾越的底線,我傾向于認(rèn)為是機(jī)器意識(shí)。或許很多意識(shí)問(wèn)題太過(guò)玄幻,談?wù)撘庾R(shí)問(wèn)題多有吸引眼球之嫌,然而即便如此,我仍要強(qiáng)調(diào)機(jī)器“自我意識(shí)“研究的嚴(yán)肅性和科學(xué)性。最近,圖靈獎(jiǎng)獲得者Yoshua Bengio(編者注:約書亞·本吉奧,圖靈獎(jiǎng)獲得者、“深度學(xué)習(xí)三巨頭”之一)的團(tuán)隊(duì)剛剛完成了一篇大模型自我意識(shí)的研究論文。從大模型的模型結(jié)構(gòu)等角度探討了其與現(xiàn)有意識(shí)理論之間的關(guān)系,并給出了當(dāng)前大模型不具備“自我意識(shí)”的判斷(注意任何科學(xué)判斷均是在某種意識(shí)理論框架下所作出的)。無(wú)論在什么情況下,我們都要守住機(jī)器自我意識(shí)這條底線。不要給人工智能盲目植入意識(shí)、要防范它的意識(shí)誕生、要監(jiān)管大模型在各種意識(shí)理論框架下的意識(shí)行為。鑒于人類的“意識(shí)”也仍然未被充分理解,對(duì)巨型大模型、具身機(jī)器人、大規(guī)模群體智能的自我意識(shí)展開嚴(yán)肅研究是必要的,也是科學(xué)的。有一些人認(rèn)為現(xiàn)在討論機(jī)器意識(shí)問(wèn)題太過(guò)前衛(wèi),更像是吆喝噱頭,旨在賺取民眾的注意力。然而,我認(rèn)為意識(shí)問(wèn)題的嚴(yán)肅研究已經(jīng)極為迫切了。“意識(shí)”問(wèn)題有很多不同的具體形式,比如在特定目標(biāo)下的自主規(guī)劃,我們的實(shí)體機(jī)器人多多少少是要具備這種低級(jí)的“意識(shí)”能力的。在開放環(huán)境中,任何“目標(biāo)”的植入都有可能帶來(lái)災(zāi)難性后果。比如無(wú)人駕駛汽車,避免碰撞行人肯定是個(gè)基本目標(biāo),然而一旦機(jī)器自主實(shí)現(xiàn)這一目標(biāo),則會(huì)出現(xiàn)很多復(fù)雜的倫理與道德難題,機(jī)器可能不得不在碰撞行人與傷害駕駛員之間進(jìn)行抉擇。所以與意識(shí)相關(guān)的自主決策、自我管理、自我糾正、自我提升,這些研究已然有著迫切應(yīng)用與研究需求,需要高度重視與控制這些研究成果的真實(shí)應(yīng)用,要做好相應(yīng)模型與方法的安全性評(píng)估分析。

結(jié)束語(yǔ)

“沒(méi)有人的文明是毫無(wú)意義的”(引自《流浪地球2》)。我們應(yīng)該堅(jiān)守人工智能發(fā)展的安全底線,對(duì)AGI的大規(guī)模產(chǎn)業(yè)應(yīng)用進(jìn)行規(guī)范、引導(dǎo)與控制。最后,每一次重大挑戰(zhàn)同時(shí)蘊(yùn)含著重大機(jī)遇。挑戰(zhàn)越是艱巨,機(jī)遇越是重大。通用人工智能發(fā)展的終極的意義是什么?我想應(yīng)該是倒逼人類重新認(rèn)識(shí)自己,從而完成人類的自我提升。我們從來(lái)沒(méi)有像今天這樣,極有可能見證一個(gè)新的智能物種的崛起,它們可以擁有我們相似的身體,更加卓越的認(rèn)知能力。那么我們何以為人?蘇格拉底說(shuō),“認(rèn)識(shí)你自己”;在通用人工智能時(shí)代,我們需要 “重新認(rèn)識(shí)你自己”,重鑄人的價(jià)值,夯實(shí)智能機(jī)器造物者的地位,宣示人對(duì)于智能機(jī)器的絕對(duì)控制的權(quán)利,成為智能機(jī)器的 “牧羊人”。

(作者肖仰華,系復(fù)旦大學(xué)教授、上海市數(shù)據(jù)科學(xué)重點(diǎn)實(shí)驗(yàn)室主任。二八法則,是工業(yè)時(shí)代的邏輯;而在智能時(shí)代,則是2%/98%的邏輯。如何成為智能時(shí)代2%的受益者?“當(dāng)見未萌”,讓我們加入浪潮吧。本專欄由計(jì)算機(jī)學(xué)界專業(yè)人士為澎湃科技讀者特供。)

- 澎湃新聞微博

- 澎湃新聞公眾號(hào)

- 澎湃新聞抖音號(hào)

- IP SHANGHAI

- SIXTH TONE

- 報(bào)料熱線: 021-962866

- 報(bào)料郵箱: news@thepaper.cn

滬公網(wǎng)安備31010602000299號(hào)

互聯(lián)網(wǎng)新聞信息服務(wù)許可證:31120170006

增值電信業(yè)務(wù)經(jīng)營(yíng)許可證:滬B2-2017116

? 2014-2025 上海東方報(bào)業(yè)有限公司